سحب وتنظيم البيانات تلقائياً باستخدام Python (Web Scraping)

تفاصيل العمل

هل تحتاج إلى جمع بيانات ضخمة من مواقع الإنترنت وتحويلها إلى ملفات منظمة وسهلة الاستخدام؟ بصفتي مهندسة برمجيات متخصصة في تحليل البيانات، أقدم لك خدمة سحب البيانات (Web Scraping) باحترافية ودقة عالية.

ما الذي ستحصل عليه في هذه الخدمة؟

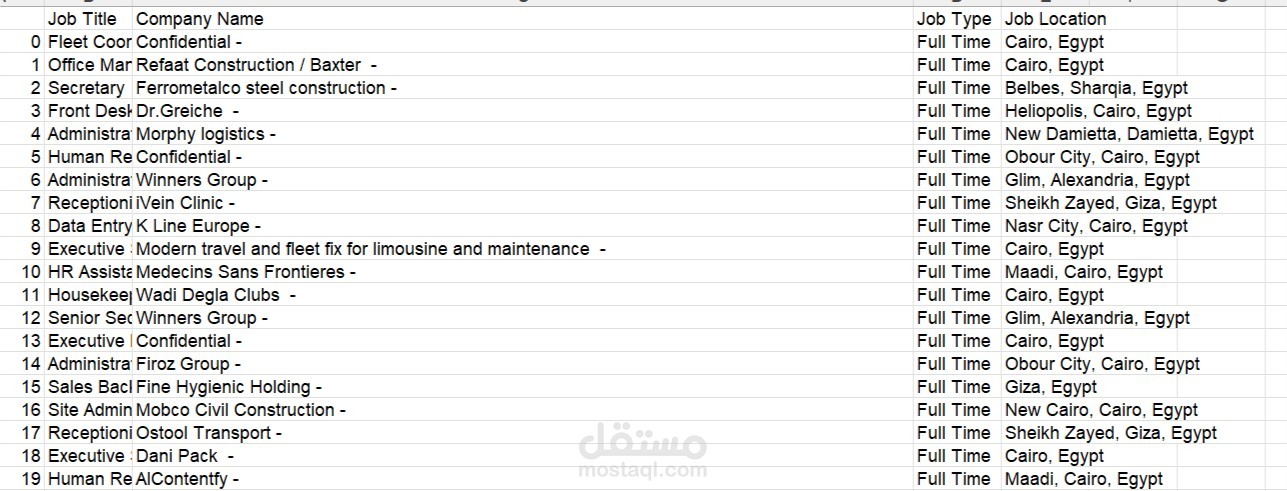

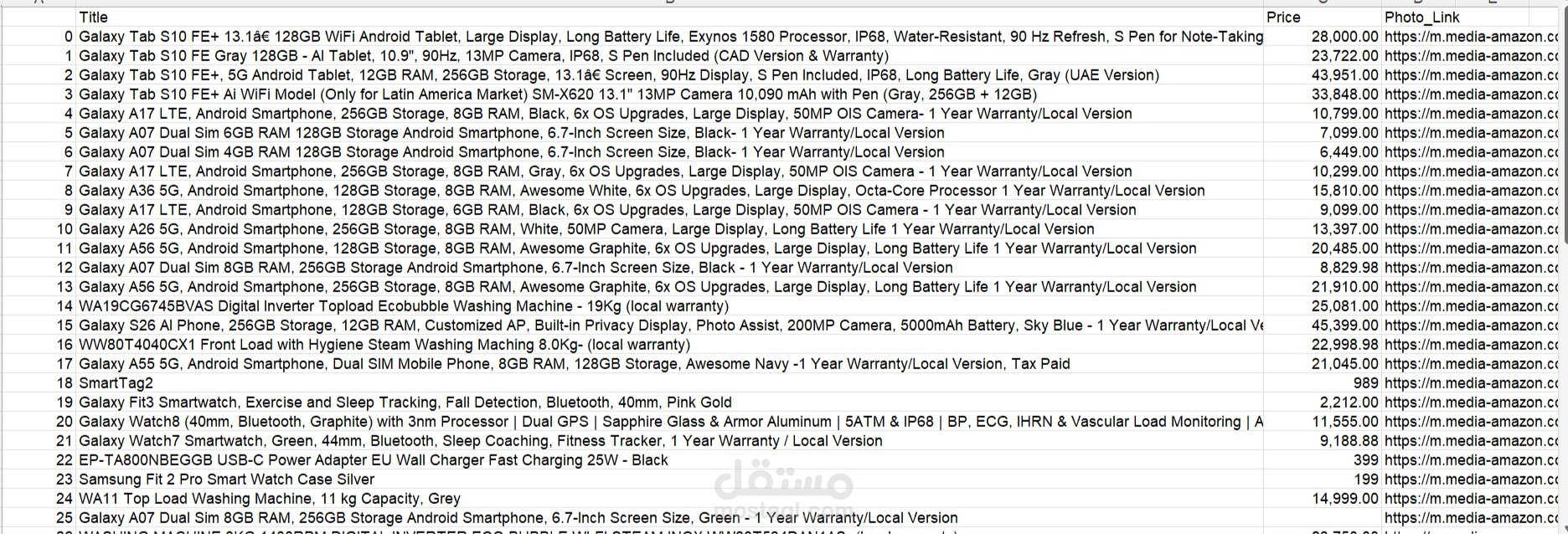

سحب البيانات: استخراج النصوص، الصور، والأسعار من المواقع المختلفة (حتى المواقع المعقدة والديناميكية).

التشغيل التلقائي: برمجة سكريبتات تعمل تلقائياً لتحديث البيانات بشكل دوري.

تنظيم البيانات: تسليم البيانات في ملفات (Excel, CSV, أو JSON) مرتبة ومنسقة باستخدام مكتبة Pandas.

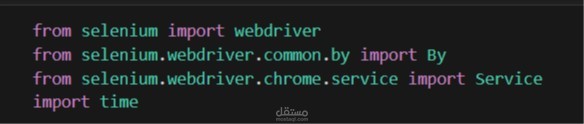

كود نظيف: سكريبت مكتوب بلغة Python ومنظم (Clean Code) ليسهل عليك تطويره مستقبلاً.

الأدوات التي أستخدمها:

BeautifulSoup للمواقع البسيطة والسريعة.

Selenium للمواقع التي تتطلب تفاعلاً أو تسجيل دخول.

Pandas لضمان أعلى جودة في تنسيق الجداول والبيانات.

لماذا تختارني؟

أجمع بين الدقة الهندسية وسرعة التنفيذ، مع ضمان الحفاظ على هيكل البيانات المطلوب وتجنب حظر المواقع (Anti-blocking techniques)."