USGS Earthquakes ELT Pipeline | خط بيانات متكامل لتحليل نشاط الزلازل العالمي

تفاصيل العمل

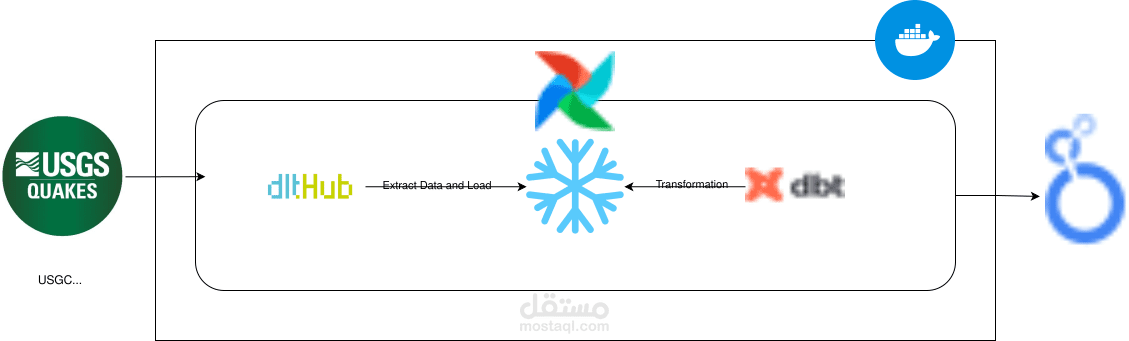

تصميم وتطوير خط بيانات (ELT Pipeline) شامل لاستخراج بيانات الزلازل العالمية لحظياً من واجهة برمجة تطبيقات (USGS REST API)، ومعالجتها لتصبح جاهزة للتحليل ولوحات المعلومات (Dashboards). يهدف المشروع إلى مساعدة فرق الإنقاذ والحكومات في فهم الأنماط الزلزالية، وتحديد المناطق الأكثر خطورة، ودراسة العلاقة بين قوة الزلازل وخطر التسونامي لتحسين استراتيجيات الاستجابة والكوارث.

?️ التقنيات المستخدمة (Tech Stack):

اللغات: Python (3.9+)

استخراج وتحميل البيانات: dlt (Data Load Tool)

تحويل البيانات (Data Modeling): dbt (Data Build Tool)

مستودع البيانات (Data Warehouse): Snowflake

أتمتة وجدولة المهام (Orchestration): Apache Airflow (عبر بيئة Astronomer)

البنية التحتية: Docker

أبرز الإنجازات والمهام التقنية (Key Achievements):

هندسة استخراج البيانات (Data Extraction): بناء اتصال برمجي لسحب بيانات الزلازل بصيغة GeoJSON من الـ API بشكل مستمر وموثوق.

التحميل الذكي (Efficient Loading): استخدام أداة dlt لمعالجة وتسطيح البيانات المتداخلة (Flattening nested JSON)، وتحميلها إلى Snowflake مع تطبيق استراتيجية (Merge/Upsert) لضمان تحديث البيانات بكفاءة ومنع التكرار (Duplicates).

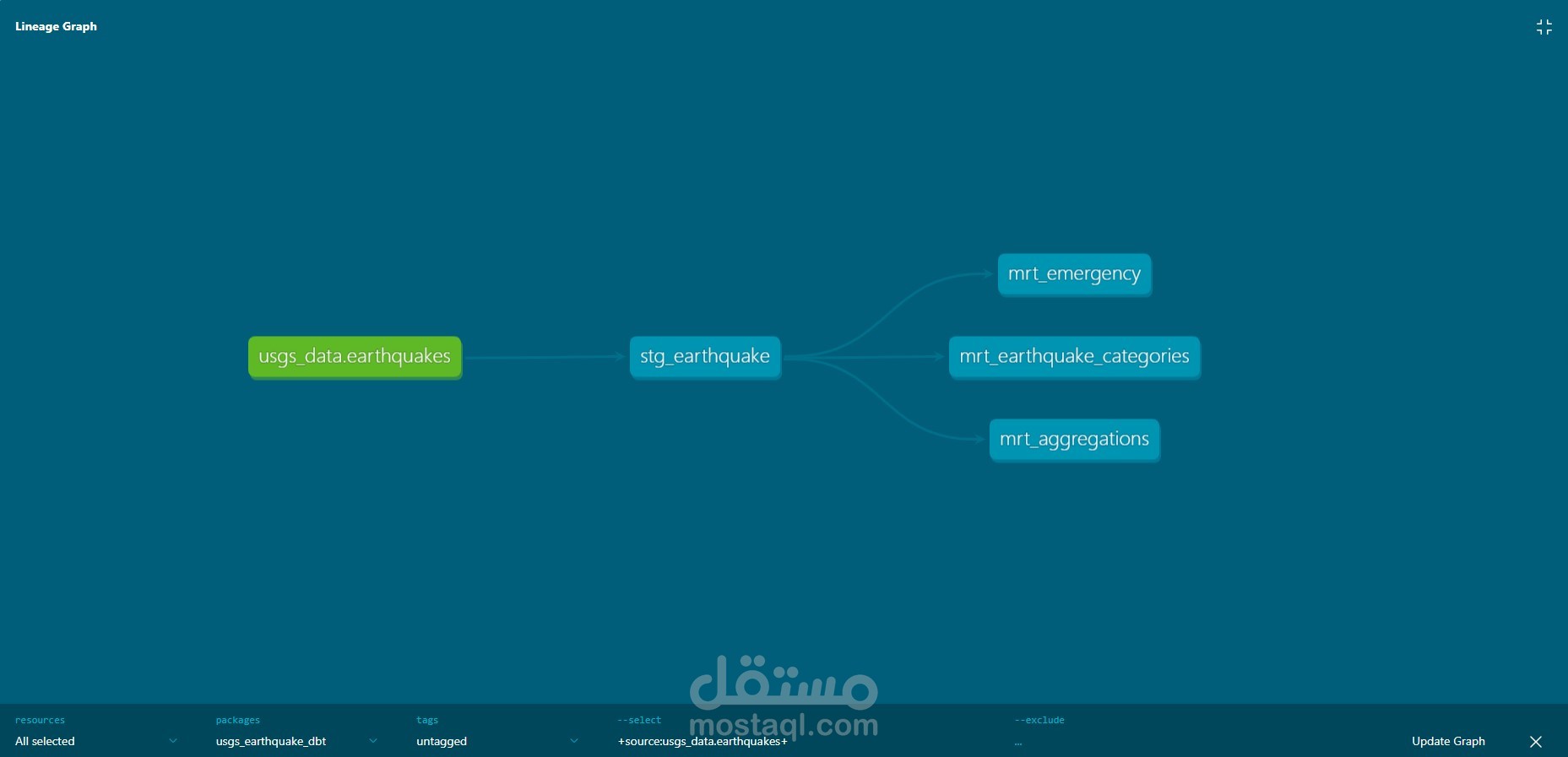

تحويل وهيكلة البيانات (Data Transformation): تطوير نماذج بيانات (SQL Models) باستخدام dbt لتنظيف البيانات الخام، توحيد صيغ التواريخ (Timestamps)، واستخراج الإحداثيات الجغرافية (خطوط الطول والعرض والعمق) لتكون جاهزة للاستخدام المباشر في أدوات ذكاء الأعمال (BI Tools).

إدارة سير العمل (Pipeline Orchestration): جدولة وإدارة الاعتماديات بين مهام الاستخراج والتحويل بالكامل باستخدام Apache Airflow لضمان تدفق البيانات بشكل آلي وخالي من الأخطاء.