تحليل سوق العمل في مجال البيانات باستخدام Web Scraping و Python

تفاصيل العمل

في هذا المشروع قمت ببناء pipeline كامل لجمع وتحليل بيانات الوظائف في مجال البيانات من منصة RemoteOK، وهي من أكبر منصات الوظائف عن بُعد في العالم.

الهدف من المشروع:

فهم سوق العمل في مجال البيانات من خلال بيانات حقيقية، والإجابة على أسئلة يحتاجها كل من يريد الدخول في هذا المجال أو تطوير مساره المهني.

كيف يعمل المشروع

1. الجمع: يتصل السكريبت بـ API المنصة تلقائياً ويستخرج الوظائف المتعلقة بـ Data Analyst, Data Scientist, Data Engineer, ML Engineer, BI Developer.

2. التنظيف: حذف المكرر، معالجة القيم الناقصة، توحيد تنسيق التواريخ والرواتب وحفظ النتائج في CSV.

3. التحليل: تحليل استكشافي كامل في Jupyter Notebook مع رسوم بيانية احترافية.

البيانات المستخرجة:

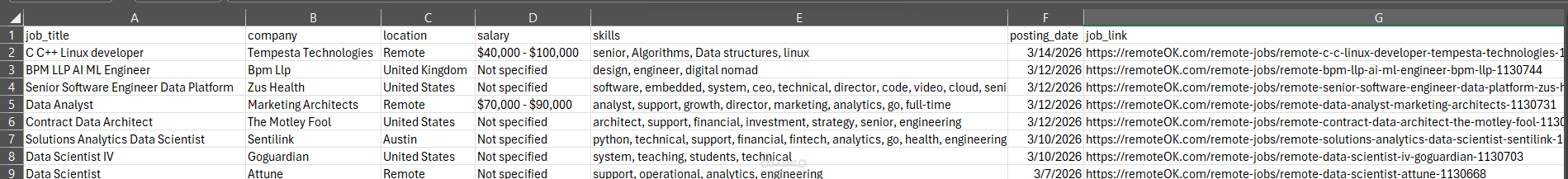

المسمى الوظيفي، الشركة، الموقع، الراتب، المهارات المطلوبة، تاريخ النشر، رابط الوظيفة.

أبرز التحليلات:

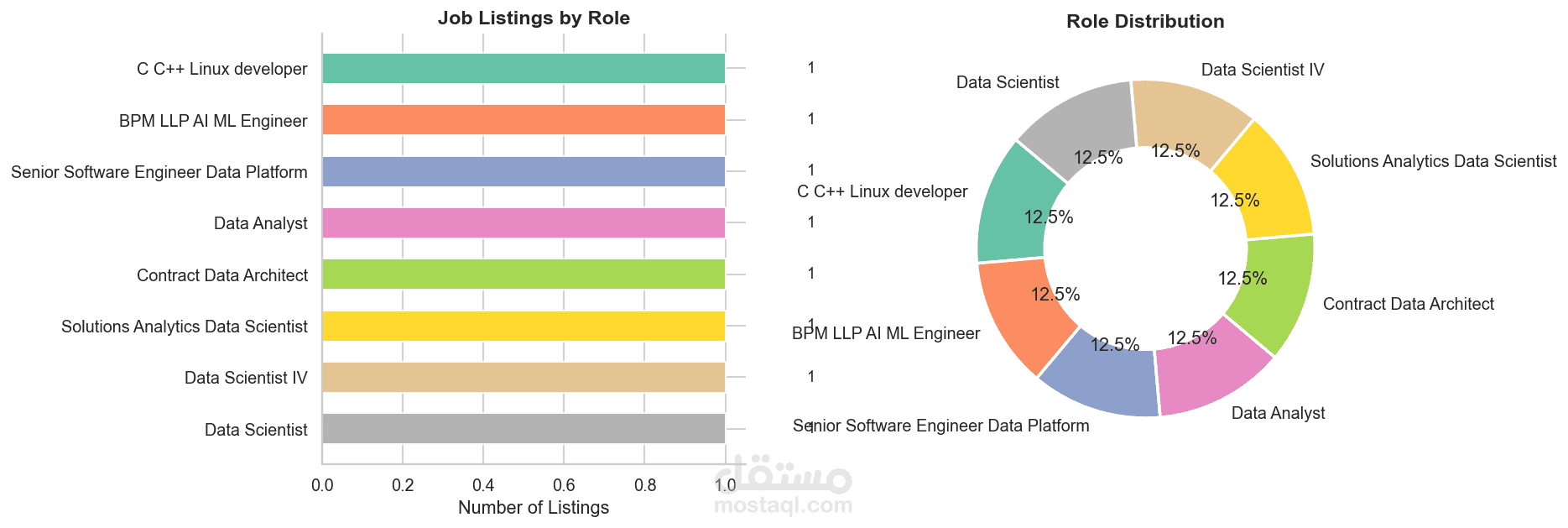

- أكثر الأدوار الوظيفية طلباً

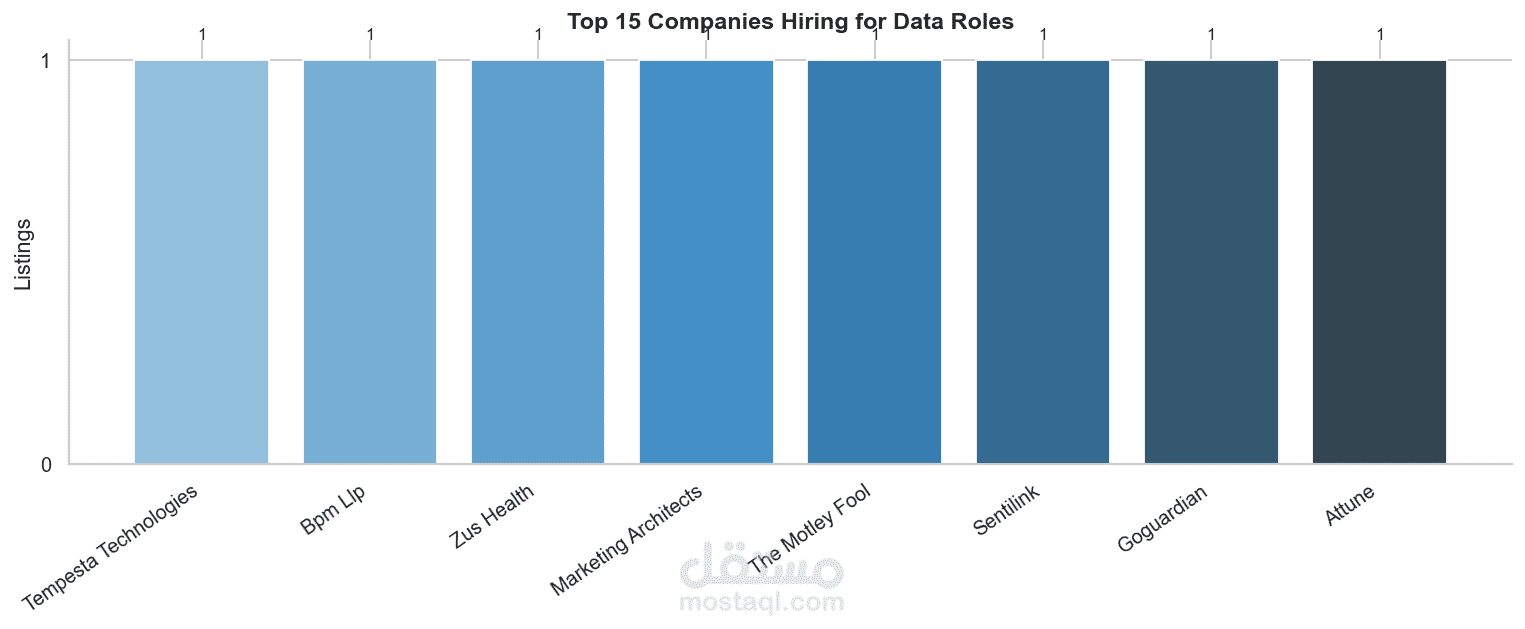

- أكثر الشركات توظيفاً

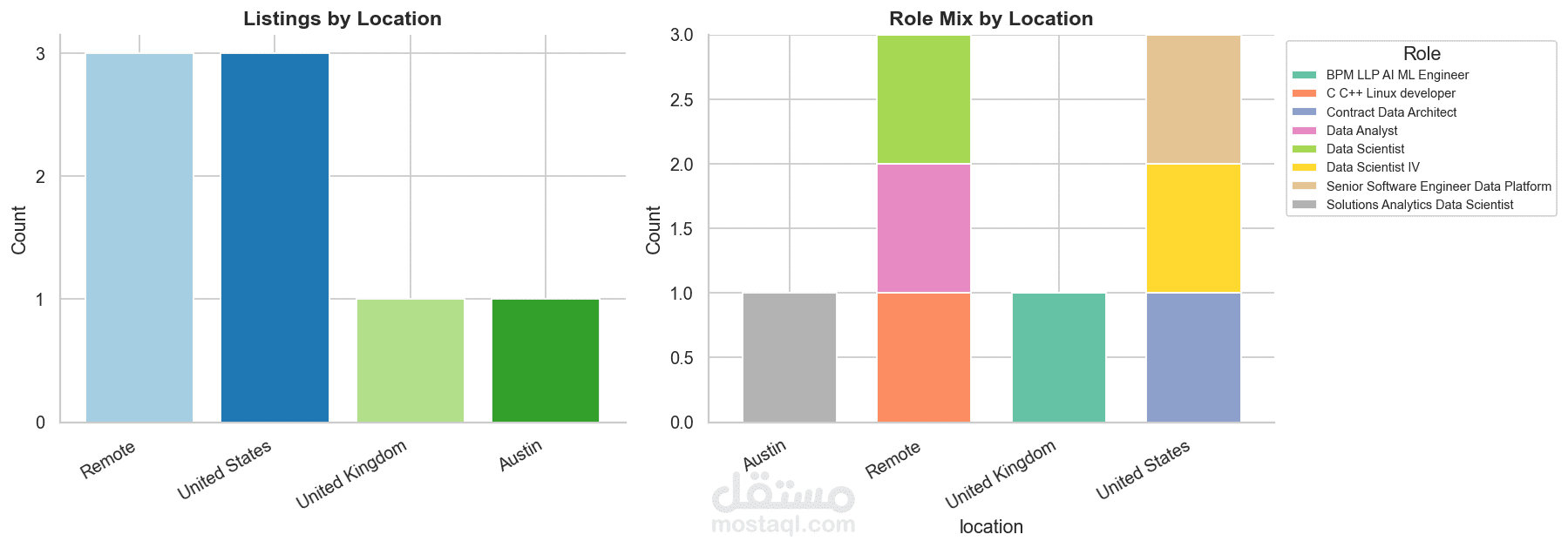

- التوزيع الجغرافي للوظائف

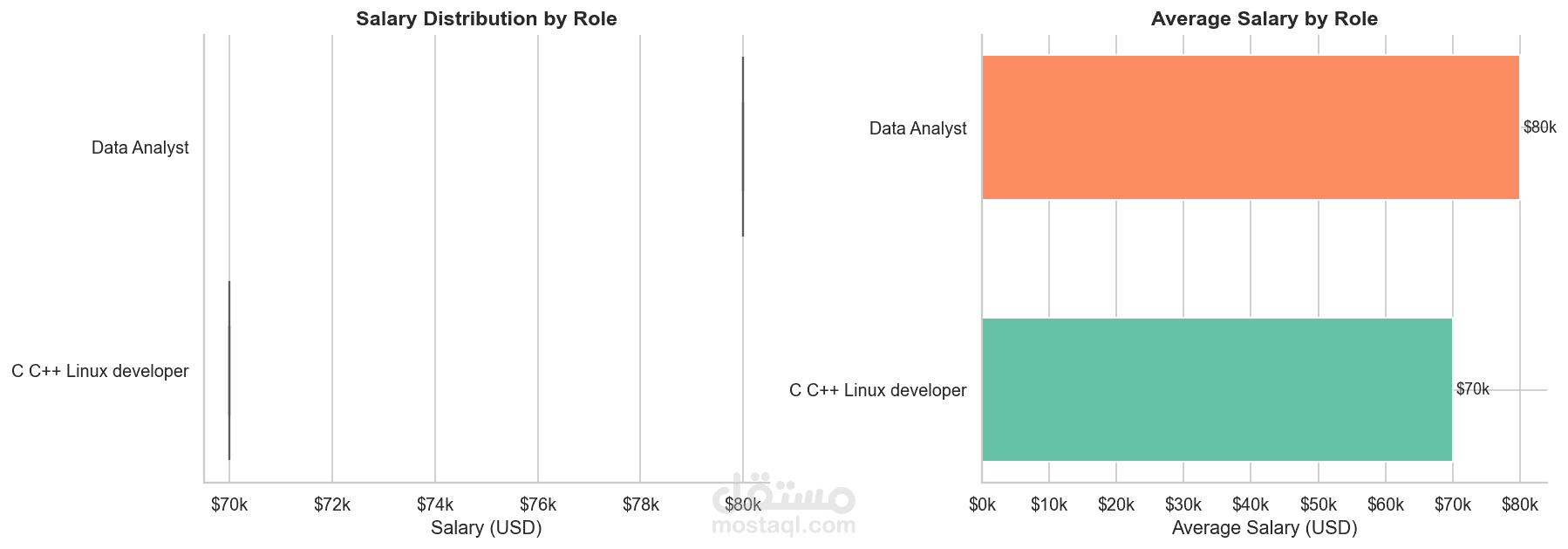

- مقارنة الرواتب بين الأدوار

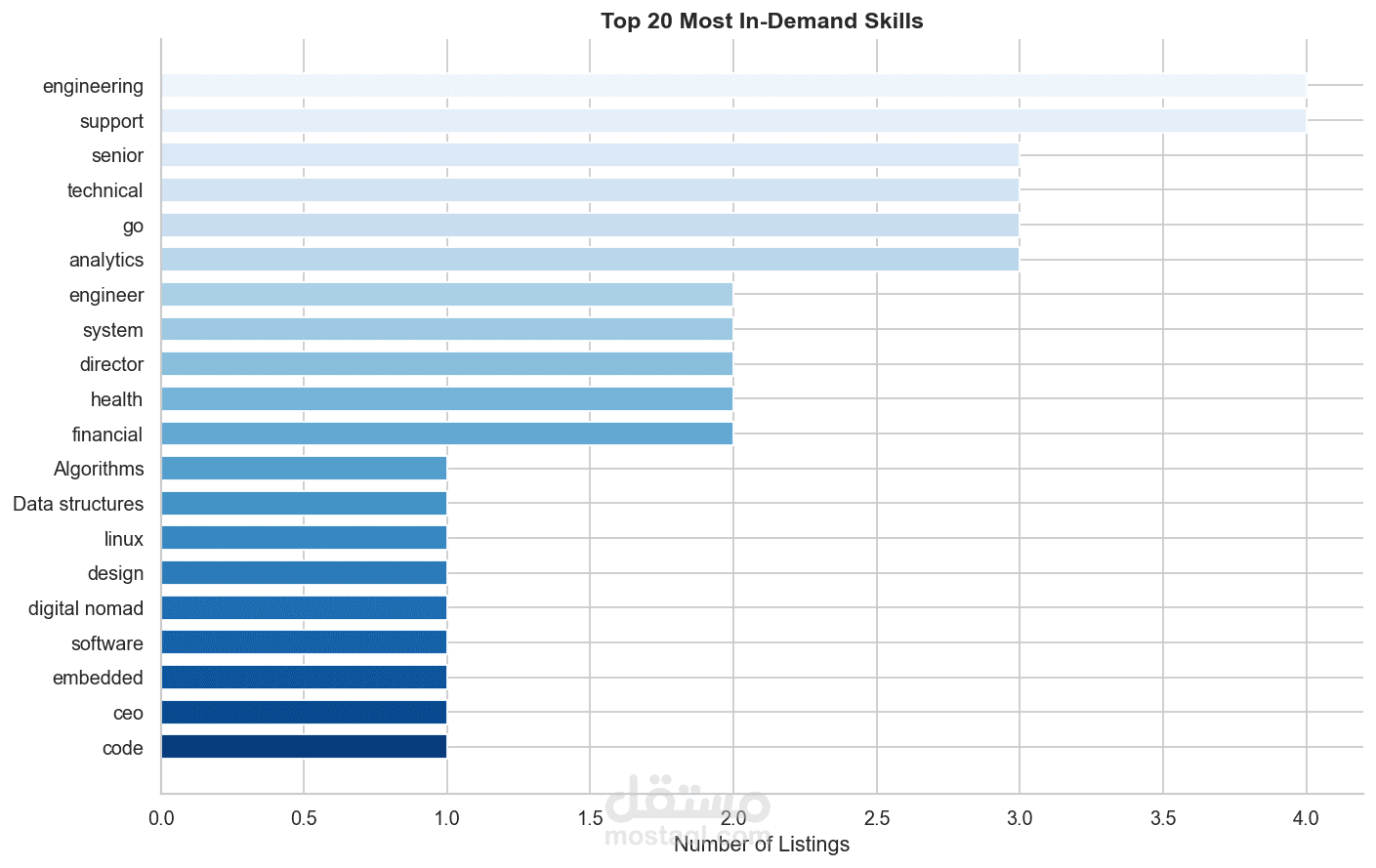

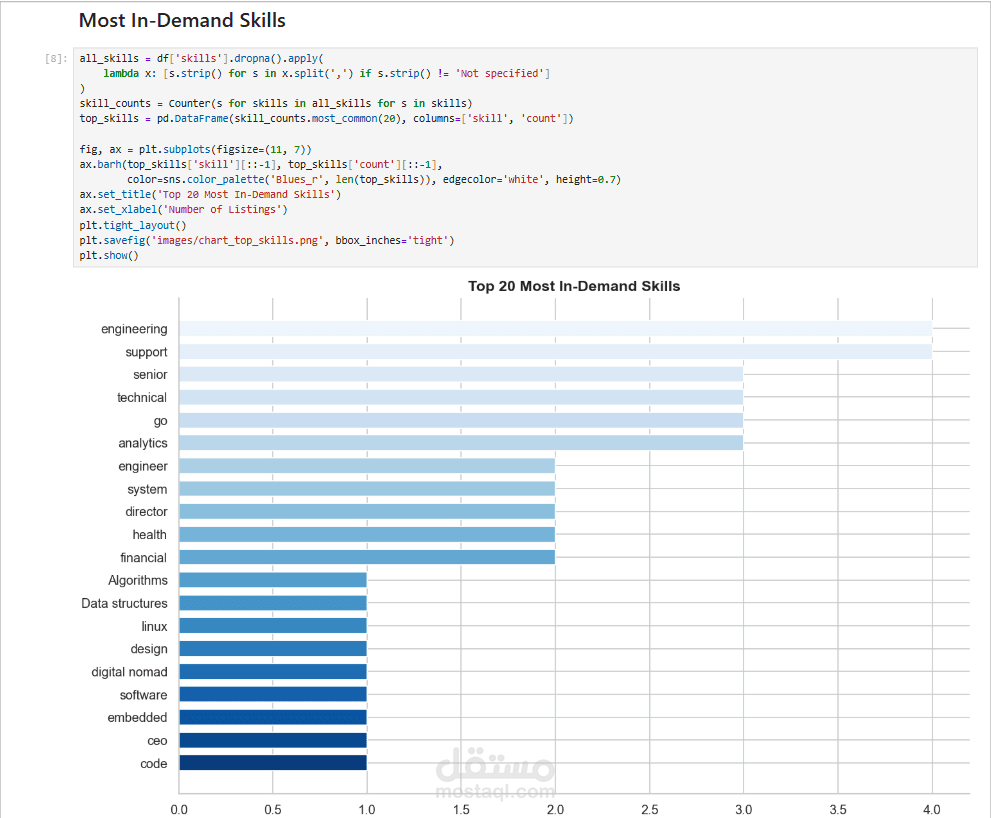

- أكثر 20 مهارة مطلوبة في السوق

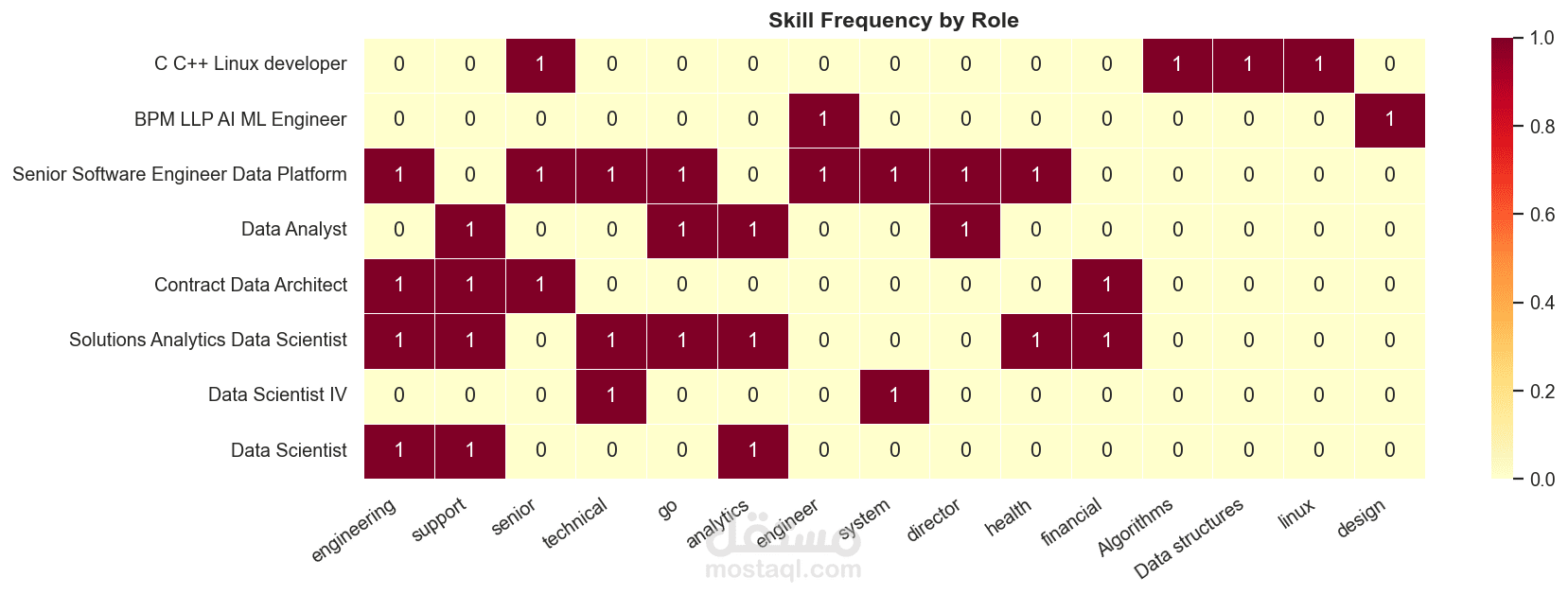

- خريطة حرارية للمهارات مقابل كل دور

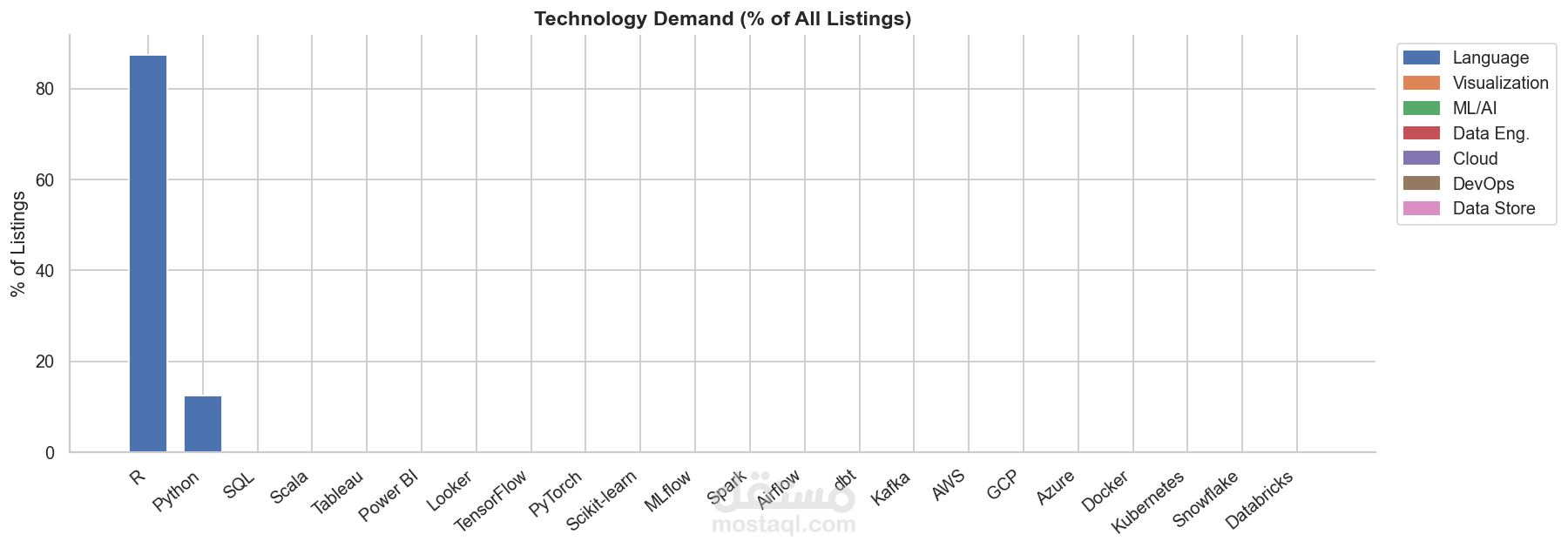

- نسبة ظهور التقنيات (Python, SQL, AWS...)

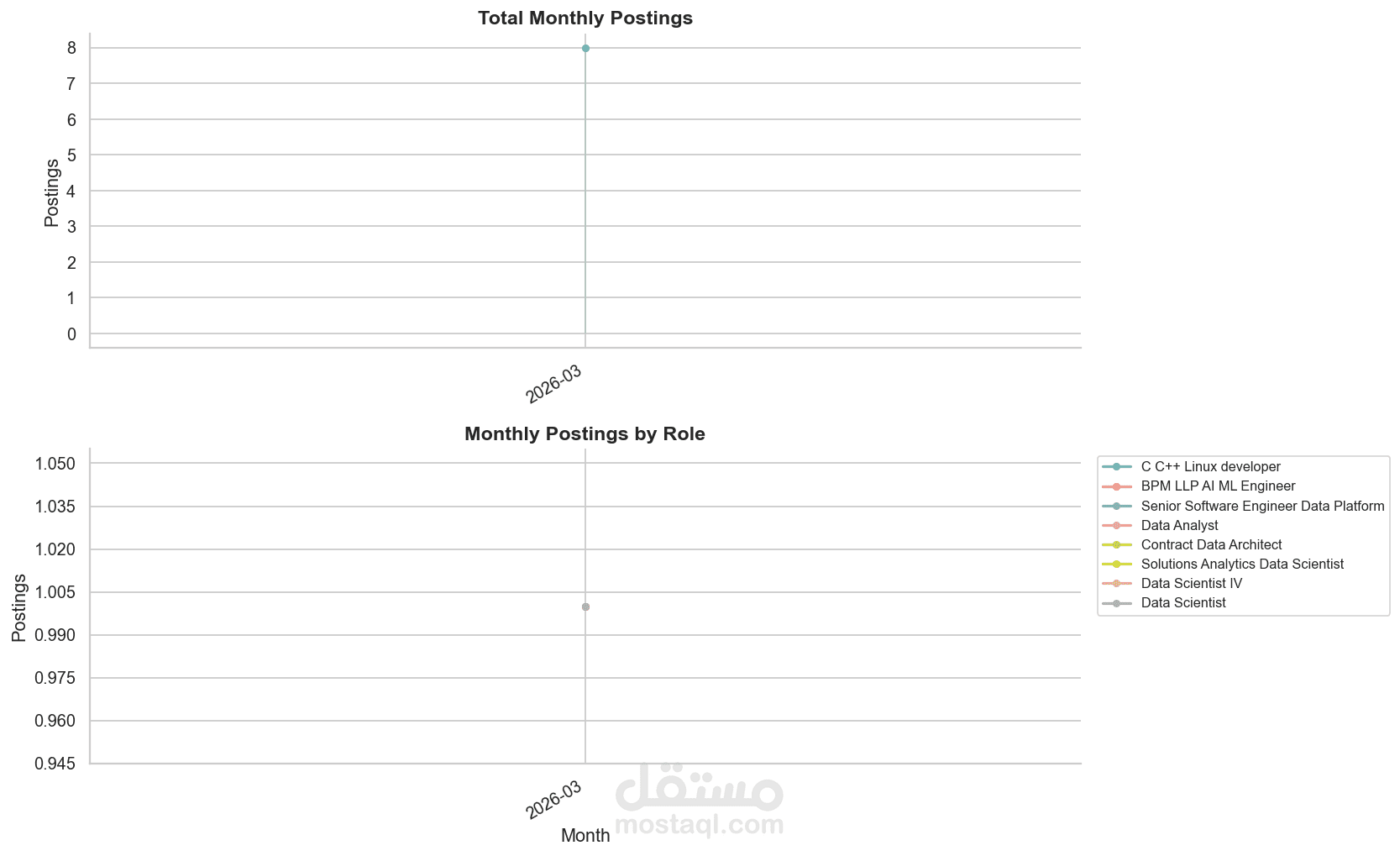

- اتجاهات النشر الشهرية

مميزات المشروع:

- يعمل بأمر واحد: python scraper.py

- الرسوم البيانية تُحفظ تلقائياً كصور PNG

- الكود كامل ومرفوع على GitHub

- يمكن إعادة تشغيله للحصول على بيانات جديدة