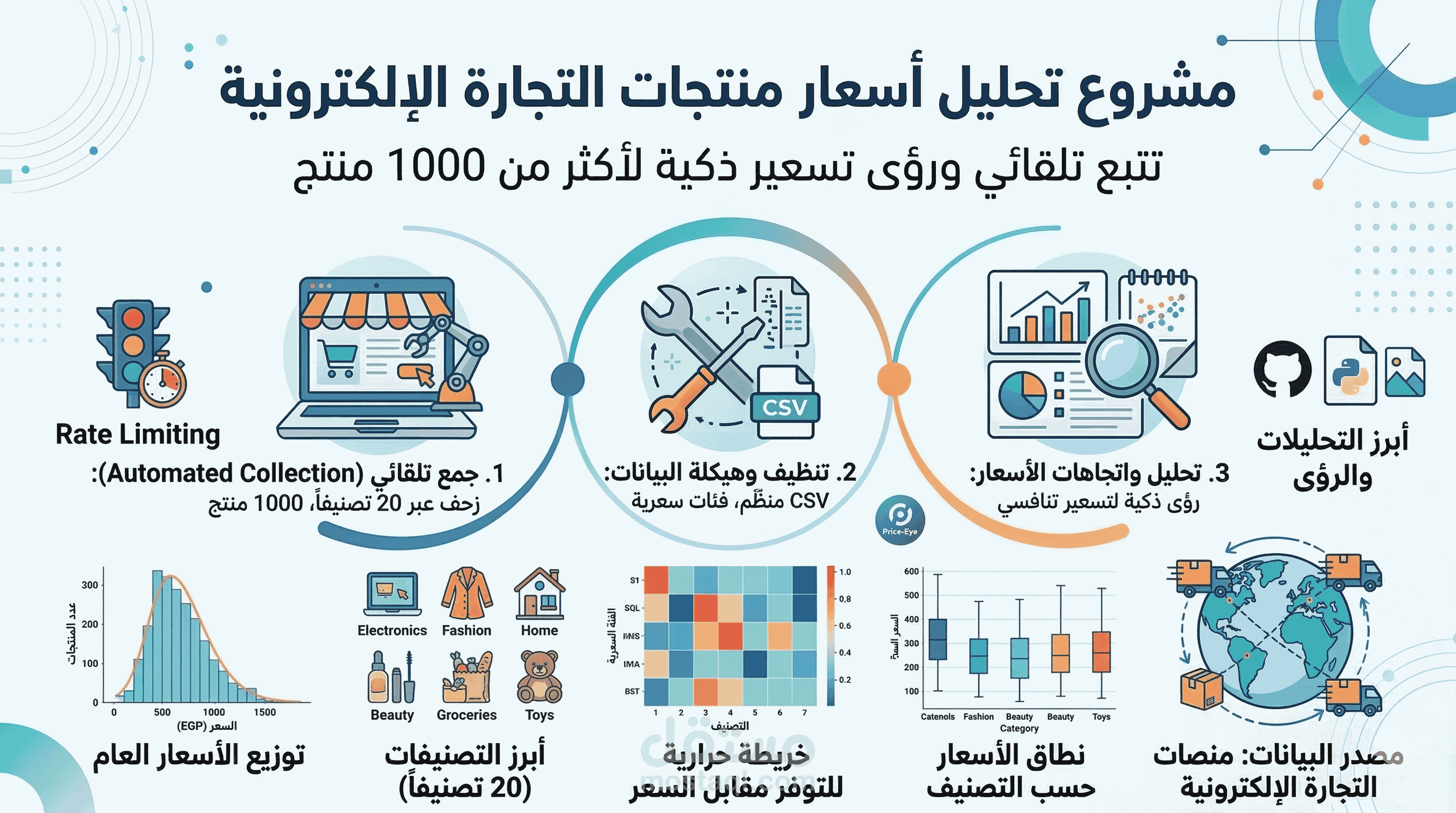

تتبع وتحليل أسعار المنتجات من موقع تجارة إلكترونية باستخدام Python

تفاصيل العمل

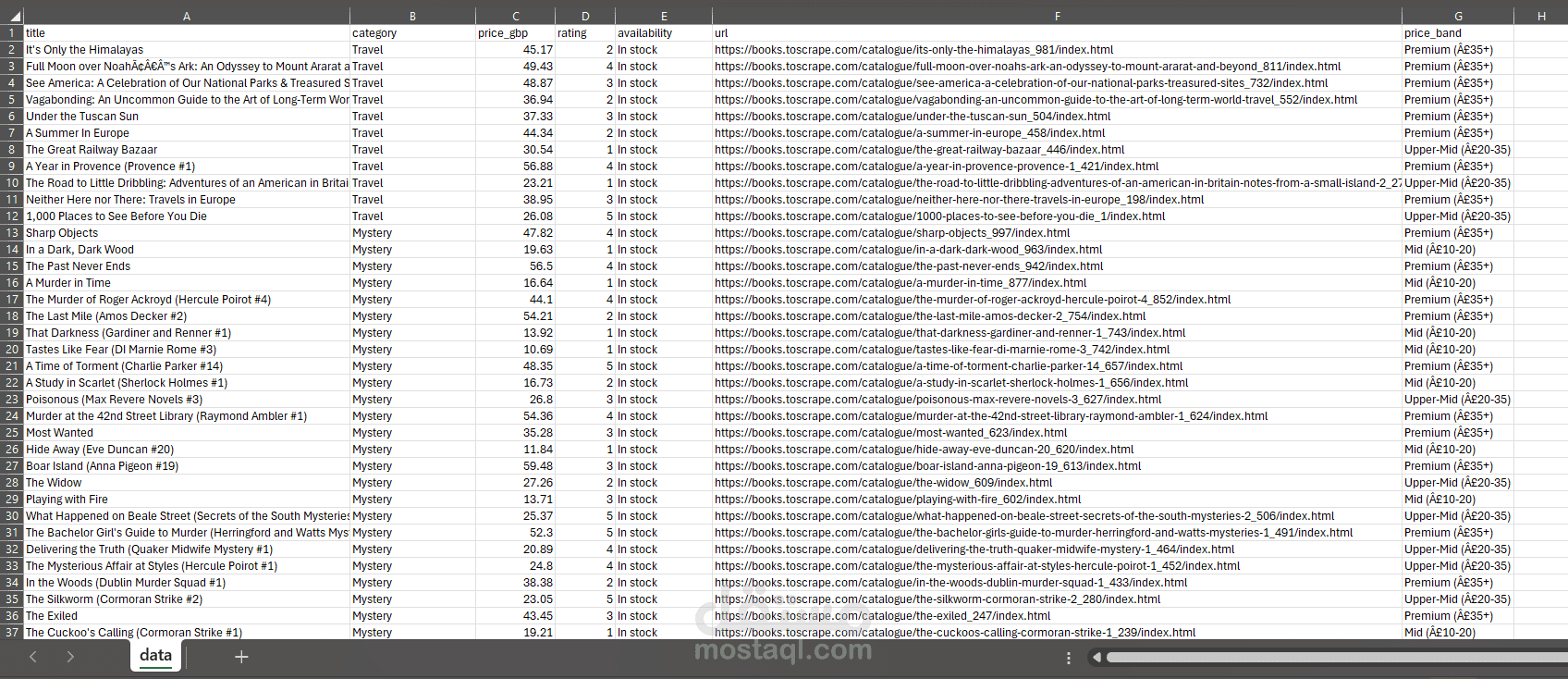

في هذا المشروع قمت ببناء أداة scraping متكاملة تجمع بيانات 1000 منتج عبر 20 تصنيفاً من موقع تجارة إلكترونية، وتحلل اتجاهات الأسعار لاستخراج رؤى تجارية مفيدة.

الهدف من المشروع:

يحاكي المشروع عمل محلل بيانات حقيقي في قطاع التجارة الإلكترونية، حيث تحتاج الشركات لتتبع الأسعار وفهم توزيع المنتجات لاتخاذ قرارات تسعير ذكية.

كيف يعمل المشروع:

1. جمع التصنيفات: يستخرج السكريبت جميع التصنيفات وروابطها من الصفحة الرئيسية تلقائياً.

2. التصفح والاستخراج: يدخل على كل تصنيف ويتصفح جميع صفحاته حتى الأخيرة مستخرجاً بيانات كل منتج.

3. التنظيف والحفظ: تنظيف البيانات، إضافة عمود الفئة السعرية تلقائياً، وحفظها في CSV منظّم.

البيانات المستخرجة:

اسم المنتج، التصنيف، السعر، التقييم، حالة التوفر، الرابط، الفئة السعرية.

أبرز التحليلات:

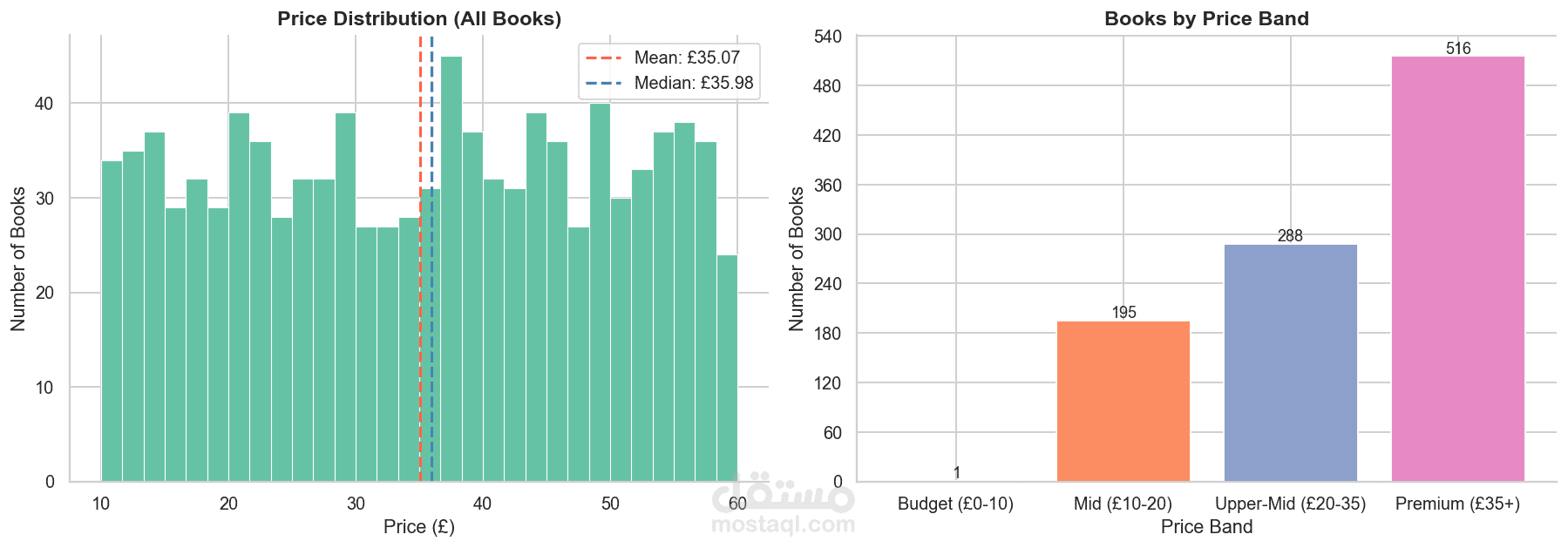

- توزيع الأسعار العام مع المتوسط والوسيط

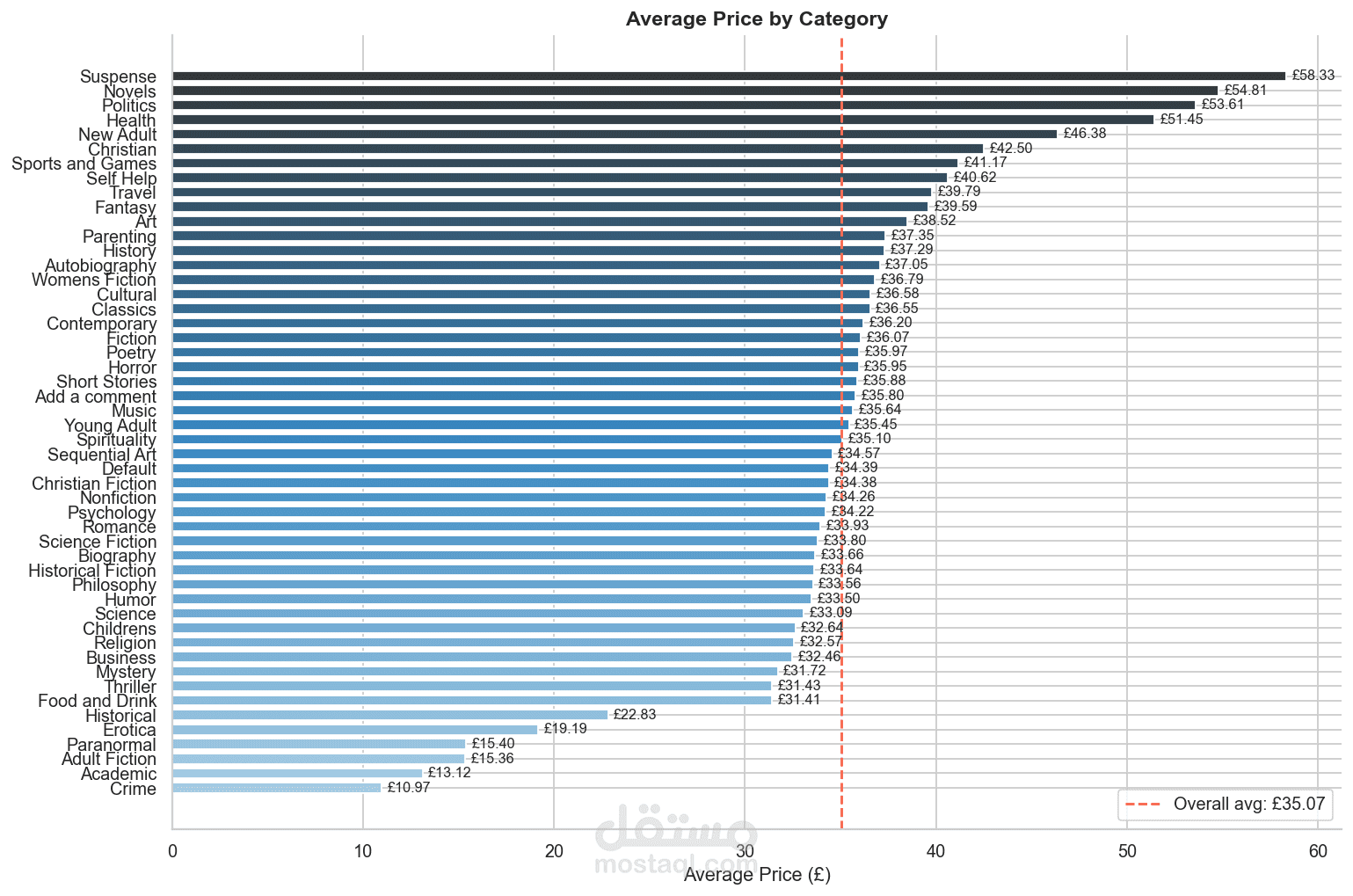

- متوسط السعر لكل تصنيف

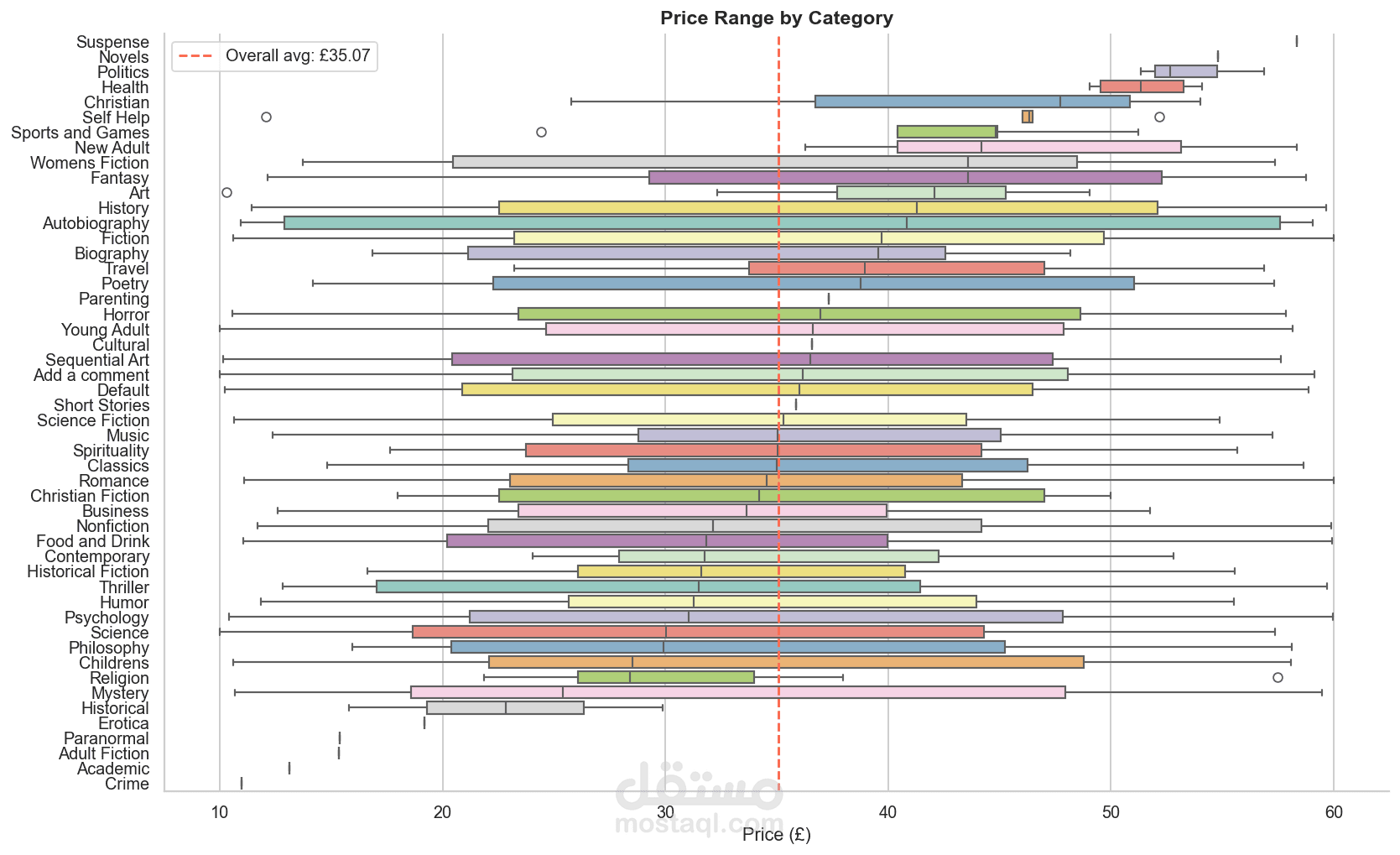

- نطاق الأسعار لكل تصنيف (Box Plot)

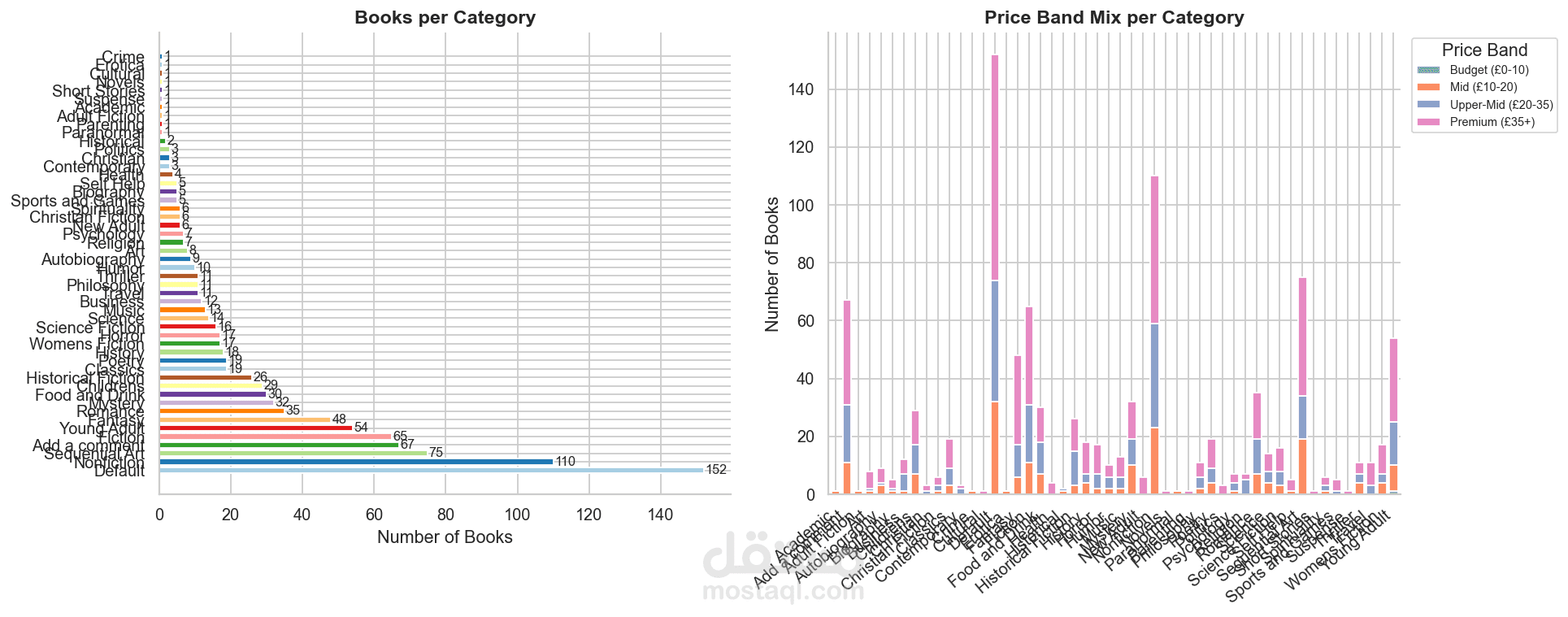

- توزيع المنتجات على الفئات السعرية

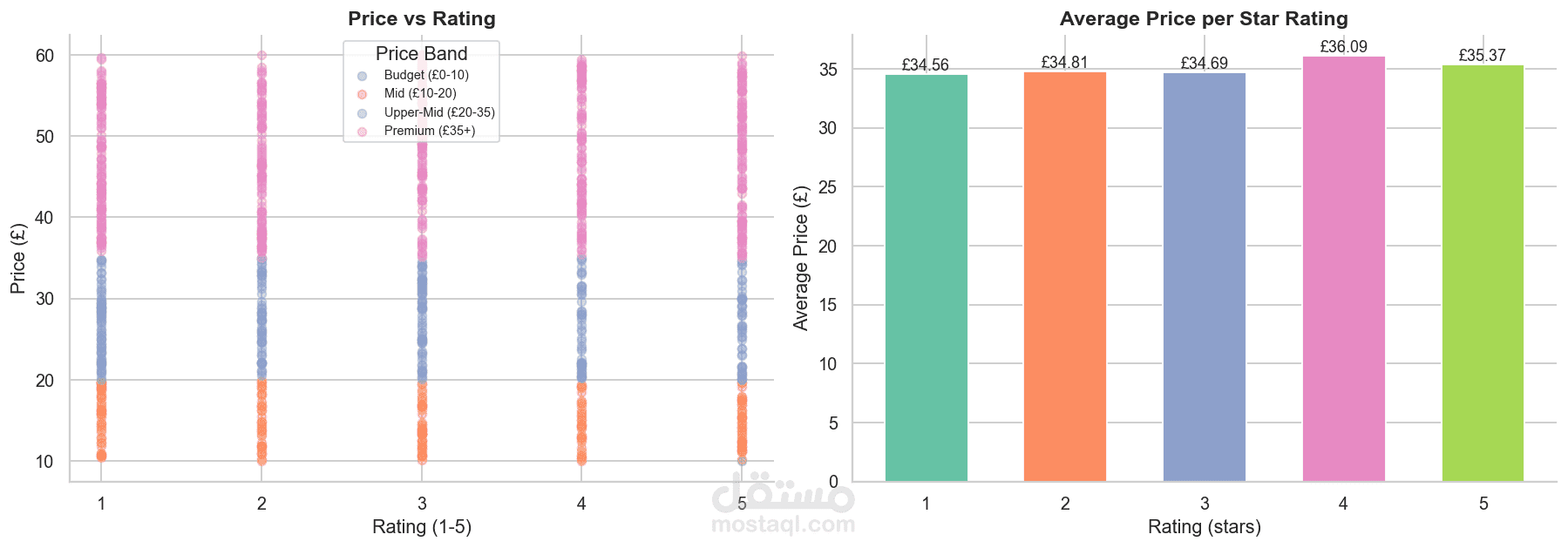

- العلاقة بين السعر والتقييم

- تحليل التوفر حسب الفئة السعرية

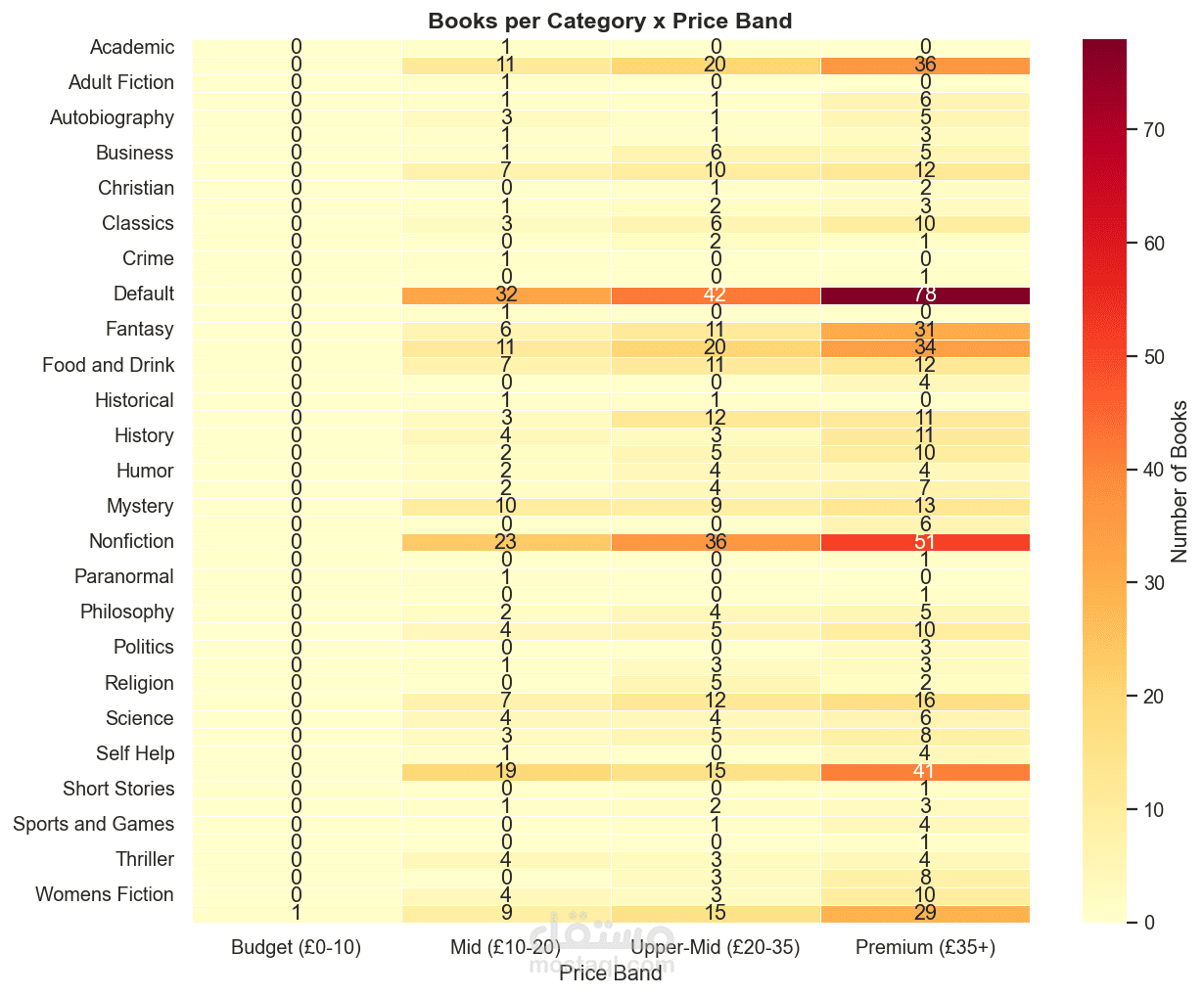

- خريطة حرارية للتصنيف مقابل الفئة السعرية

مميزات المشروع:

- يتصفح أكثر من 50 تصنيفاً وصفحة تلقائياً

- Rate limiting مدمج لتجنب الحظر

- 1000 سجل في CSV واحد منظّم

- الرسوم البيانية تُحفظ تلقائياً في مجلد images

- الكود كامل ومرفوع على GitHub