معالجة البيانات الضخمة (Big Data Processing) باستخدام Apache Spark

تفاصيل العمل

تنفيذ حلول برمجية لمعالجة وتحليل كميات ضخمة من البيانات بكفاءة عالية باستخدام إطار العمل Apache Spark (عبر مكتبة PySpark)، مما يضمن سرعة المعالجة وقابلية التوسع (Scalability).

أبرز المهام التي تم تنفيذها:

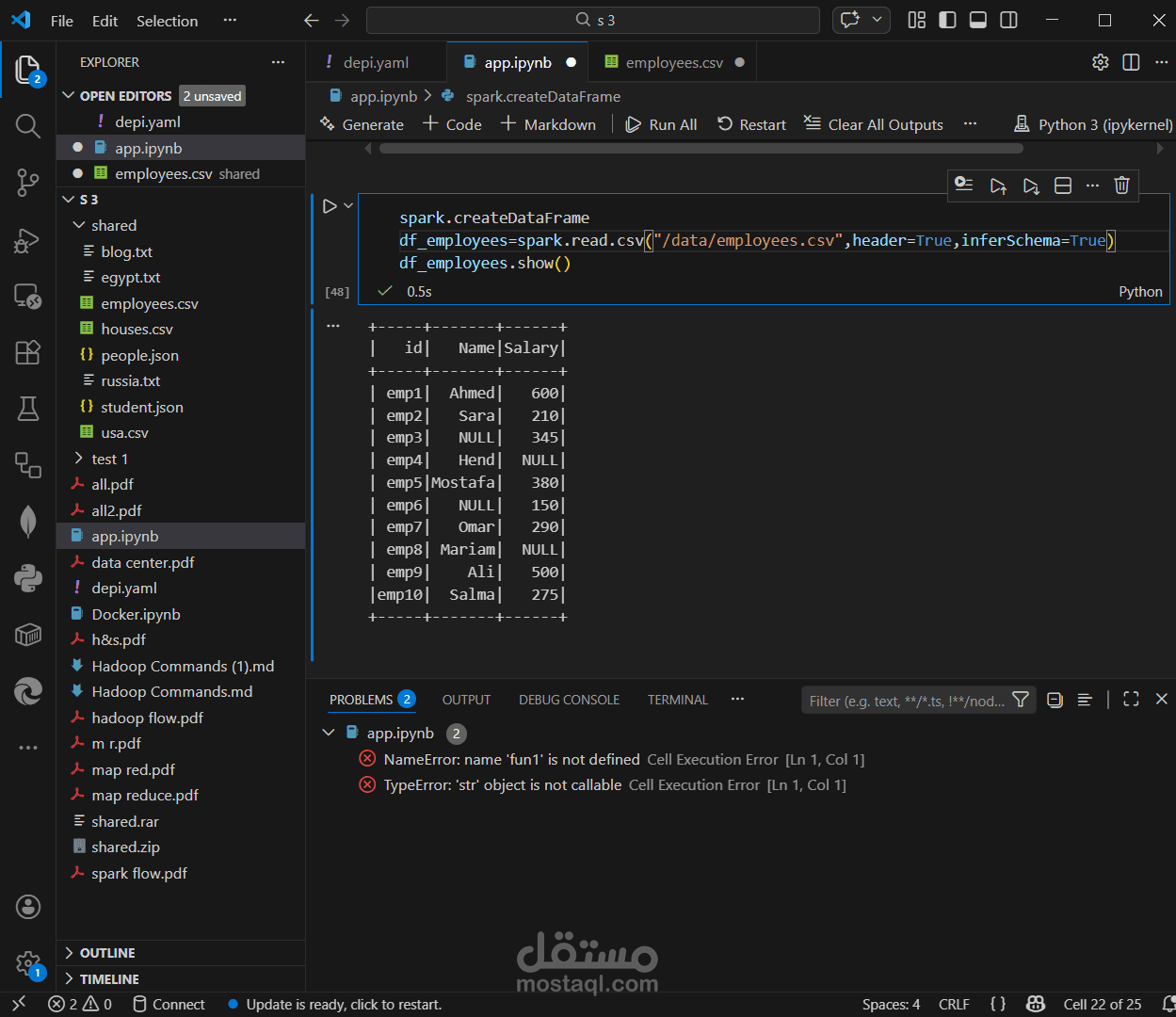

معالجة البيانات الموزعة: بناء سكربتات لقراءة ومعالجة الملفات الضخمة (مثل CSV و JSON) مع تفعيل خاصية الـ Infer Schema لضمان تعريف أنواع البيانات تلقائياً وبدقة.

تحليل البيانات وتحويلها: استخدام Spark DataFrames لإجراء عمليات التصفية (Filtering) والتحويل المعقدة على البيانات في بيئة عمل موزعة.

إدارة جودة البيانات: التعامل مع القيم المفقودة (Nulls) وتجهيز البيانات لتكون جاهزة لعمليات الـ Machine Learning أو التقارير التحليلية.

التعامل مع بيئات Hadoop: العمل ضمن بيئة تدعم تقنيات Hadoop و HDFS لضمان تكامل البيانات وتخزينها بشكل فعال.

الأدوات والتقنيات المستخدمة:

Core Tool: Apache Spark (PySpark).

Programming: Python.

Environment: Jupyter Notebooks / VS Code.

Data Concepts: Distributed Computing, Schema Inference, Data Cleaning.