نظام تحليل بيانات ضخمة باستخدام Big Data Tools

تفاصيل العمل

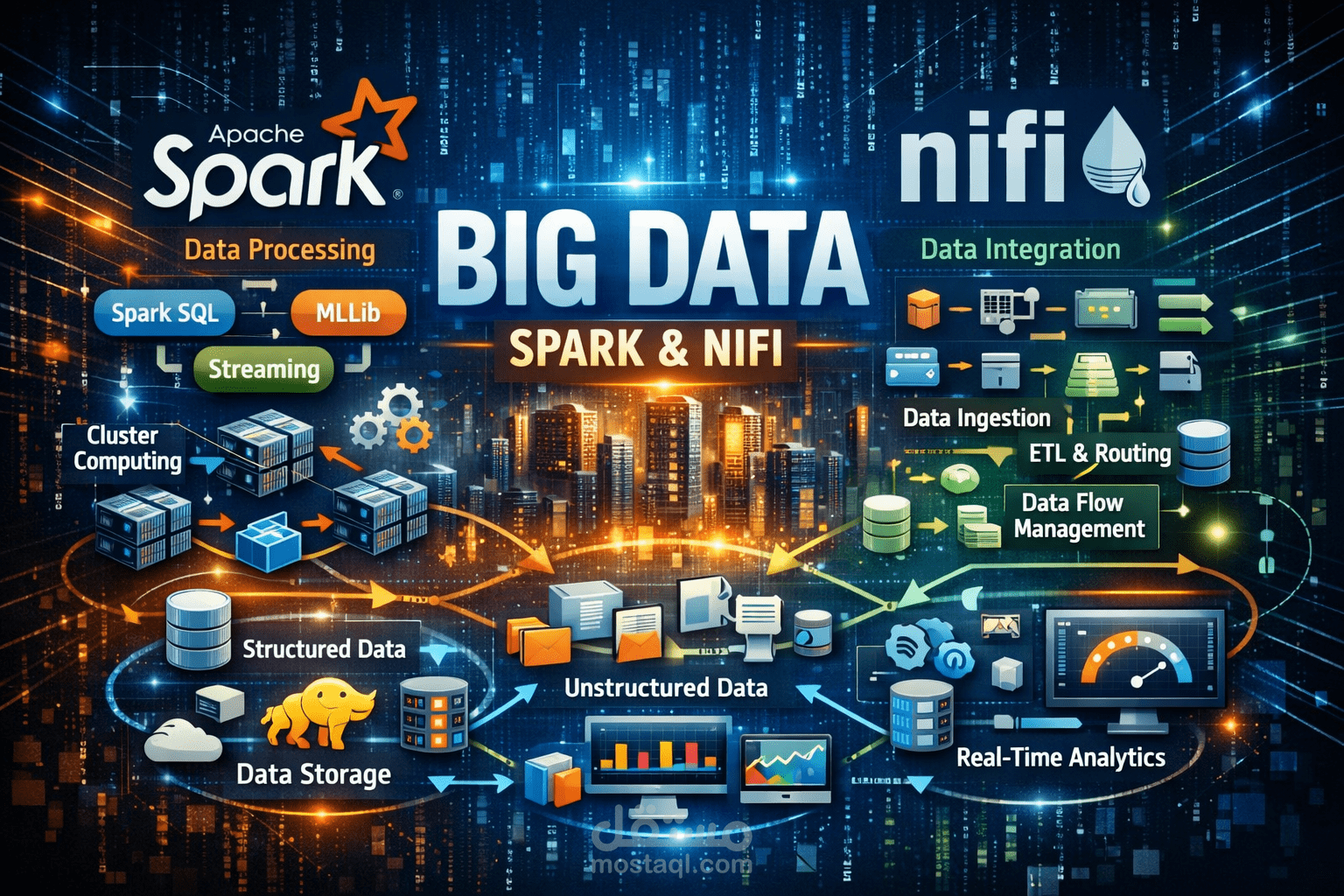

مشروع يوضح كيفية بناء Pipeline لمعالجة وتحليل البيانات الضخمة (Big Data Pipeline) باستخدام مجموعة من أشهر أدوات الـ Big Data الحديثة.

يعتمد المشروع على عدة مراحل لمعالجة البيانات بداية من جمعها وحتى تحليلها واستخراج المعلومات المفيدة منها.

الأدوات والتقنيات المستخدمة

Apache Hadoop (HDFS) لتخزين البيانات بشكل موزع على عدة عقد.

Apache Kafka لاستقبال البيانات بشكل مستمر (Data Streaming / Data Ingestion).

Apache Flink لمعالجة البيانات اللحظية (Real-Time Stream Processing).

Elasticsearch لتحليل البيانات والبحث السريع داخلها.