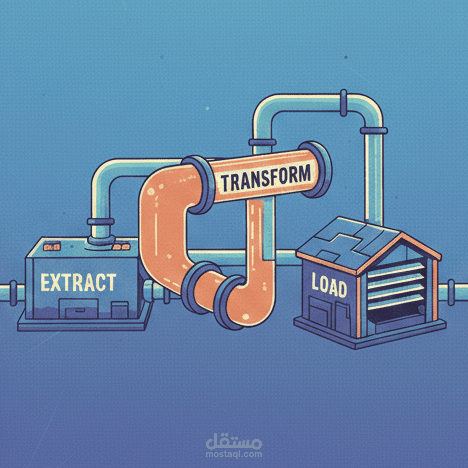

نظام ETL مرن مبني باستخدام Pandas لقراءة ملفات CSV، تنظيف البيانات ومعالجة القيم الفارغة، تحويل الحقول الرقمية، حذف السجلات غير الصالحة، ثم حفظ النتائج النهائية تلقائيًا في ملف وجهة محدد.

تفاصيل العمل

أقدّم خدمة بناء بايبلاين معالجة بيانات (ETL Pipeline) باستخدام Python وPandas، مناسبة لتنظيف البيانات، تحويلها، وتجهيزها للاستخدام في التحليل أو أنظمة هندسة البيانات.

يعتمد العمل على تصميم بايبلاين منظم وقابل لإعادة الاستخدام يقوم باستخراج البيانات من مصدر خارجي (مثل ملفات CSV)، ثم معالجتها وتنظيفها عبر خطوات تحويل واضحة مثل معالجة القيم المفقودة، تصحيح الأنواع، وإزالة البيانات غير الصالحة، وأخيرًا تحميل البيانات النظيفة إلى وجهة جديدة جاهزة للاستخدام.

مميزات الخدمة:

* كود منظم بأسلوب OOP لسهولة التوسع والتعديل

* إعدادات مرنة عبر ملفات Config بدون تعديل الكود

* تنظيف وتحويل احترافي للبيانات (Data Cleaning & Transformation)

* قابلية دمجه لاحقًا مع قواعد بيانات أو أنظمة Data Pipelines أكبر

* مناسب لمشاريع التحليل، لوحات البيانات، أو تجهيز الداتا للـ Machine Learning

طريقة التنفيذ:

أقوم أولًا بفهم هيكل البيانات والمصدر المطلوب، ثم تصميم Pipeline مخصص حسب احتياجات المشروع. بعد ذلك يتم تطوير الكود واختباره على البيانات الفعلية، مع تسليم نسخة نظيفة ومشروحة يمكن تشغيلها بسهولة أو دمجها ضمن مشروعك.

الخدمة مناسبة لأصحاب المشاريع، محللي البيانات، أو أي شخص يحتاج تجهيز بيانات بشكل احترافي قبل التحليل أو التخزين.