SHATO – منصة تفاعلية صوتية ذكية متعددة الخدمات باستخدام LLM وDocker

تفاصيل العمل

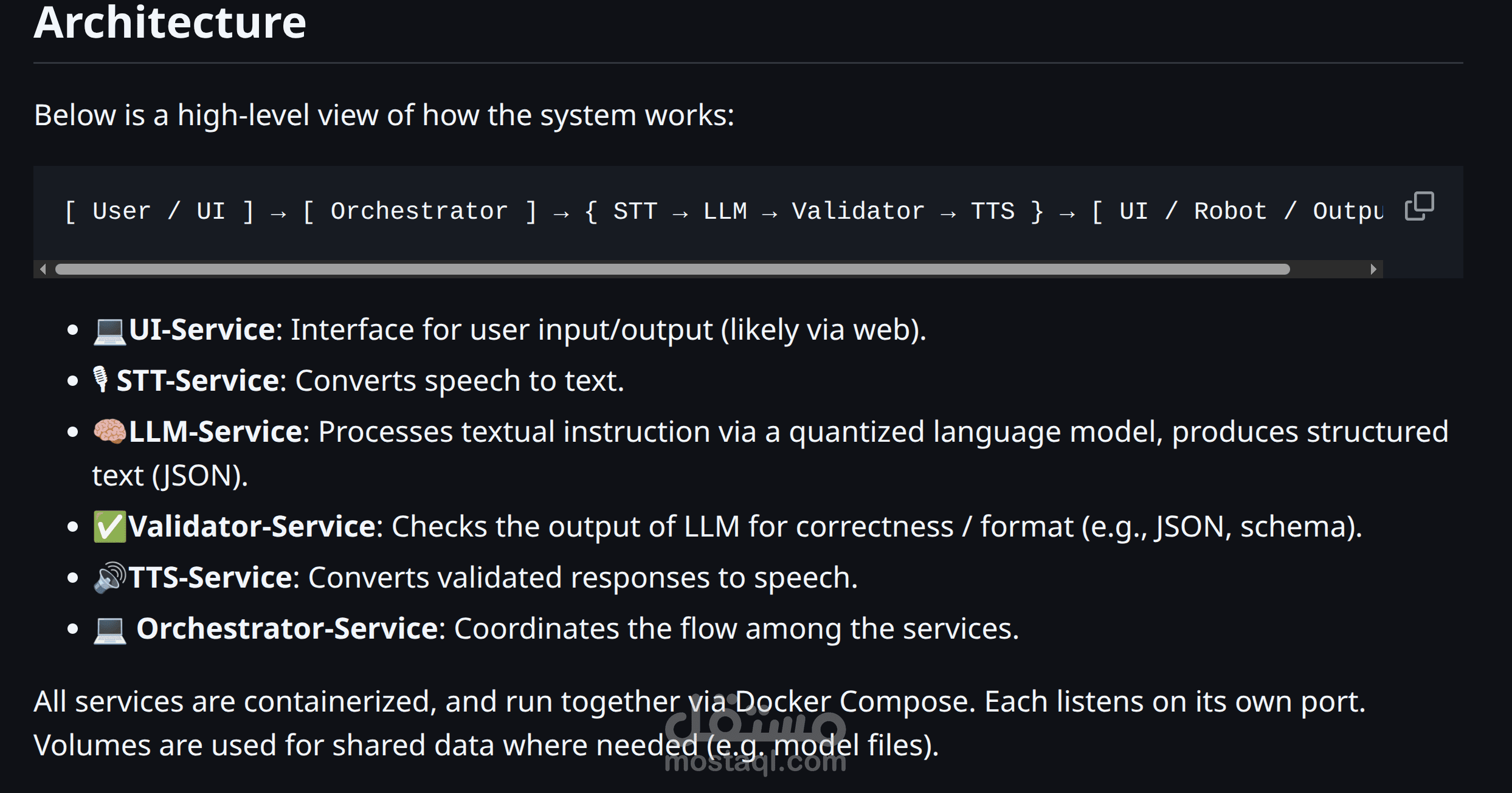

مشروع SHATO هو منصة ذكاء اصطناعي تفاعلية تعتمد على بنية Microservices (خدمات منفصلة) ومبنية باستخدام Docker Compose، وهدفها تنفيذ تفاعل صوتي متكامل من البداية للنهاية.

يقوم النظام بتحويل الكلام إلى نص (STT)، ثم إرسال النص إلى نموذج لغوي كبير (LLM) لإنتاج استجابة أو أوامر بصيغة منظمة (مثل JSON)، وبعد ذلك يتم التحقق من صحة المخرجات عبر خدمة Validator، ثم تحويل النص إلى صوت مرة أخرى (TTS) وعرض النتيجة للمستخدم عبر واجهة استخدام بسيطة (Gradio UI).

مكونات المشروع الأساسية

stt-service: تحويل الصوت إلى نص (Speech-to-Text).

llm-service: معالجة النص باستخدام نموذج LLaMA كموديل لغوي وإنتاج مخرجات منظمة.

validator-service: التحقق من صحة المخرجات (مثل JSON/schema).

tts-service: تحويل النص إلى صوت (Text-to-Speech).

orchestrator-service: تنسيق الاتصال بين جميع الخدمات.

ui-service: واجهة المستخدم للتفاعل مع النظام.

التقنيات المستخدمة

Python

FastAPI

Docker / Docker Compose

Gradio

Whisper (STT)

llama.cpp / نموذج LLaMA quantized (GGUF)

أدوات TTS (مثل Coqui TTS / pyttsx3)

مميزات المشروع

تصميم Modular يسهل تطوير أو استبدال أي خدمة بشكل مستقل.

يدعم التفاعل الصوتي الكامل (صوت → نص → فهم → تحقق → صوت).

مناسب لتطبيقات الروبوتات أو الأنظمة التي تحتاج مخرجات منظمة وموثوقة.

سهل التشغيل والنشر محليًا باستخدام Docker Compose.