تطوير نظام ذكاء اصطناعي لتوليد وصف تلقائي للصور باستخدام التعلم العميق

تفاصيل العمل

تطوير نظام ذكاء اصطناعي لتوليد وصف تلقائي للصور (Image Captioning) باستخدام Deep Learning

### **وصف المشروع:**

قمت بتطوير نظام متقدم يجمع بين الرؤية الحاسوبية (Computer Vision) ومعالجة اللغات الطبيعية (NLP) بهدف توليد جمل وصفية دقيقة ومترابطة للصور بشكل آلي. يعتمد المشروع على تحليل محتوى الصورة واستخلاص الميزات منها، ثم تحويل هذه الميزات إلى نص بشري مفهوم.

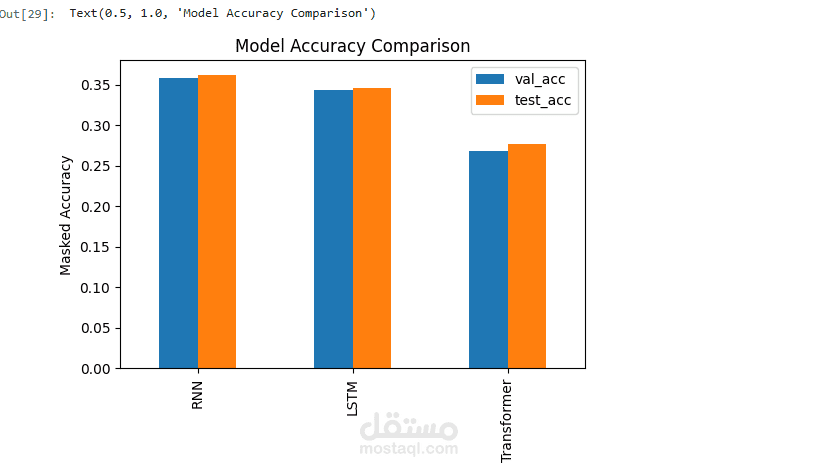

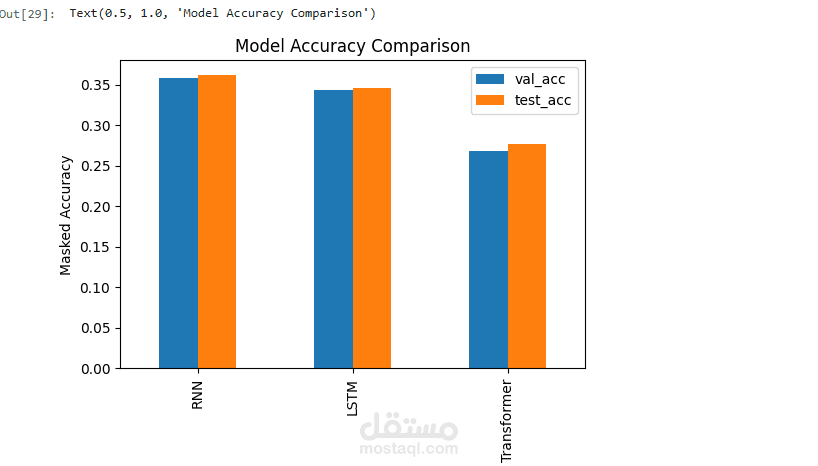

لقد قمت بإجراء دراسة مقارنة بين ثلاث معماريات مختلفة للشبكات العصبية العميقة للوصول إلى أفضل أداء ومصداقية في النتائج:

1.

**الشبكات العصبية المتكررة (RNN):** كنموذج أساسي للمقارنة.

2.

**الذاكرة الطويلة قصيرة المدى (LSTM):** للتعامل مع تسلسل الجمل الطويلة والحفاظ على سياق الكلام.

3.

**المحولات (Transformers):** باستخدام تقنية "Multi-Head Attention" لتحقيق فهم أعمق للعلاقات بين الكلمات.

### **خطوات العمل والمنهجية التقنية:**

*

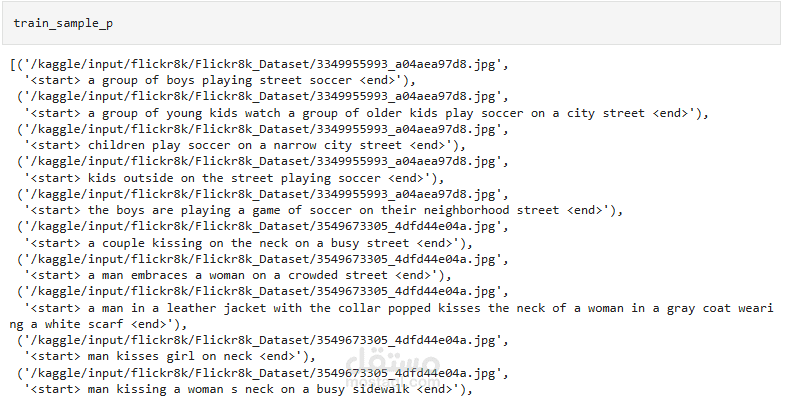

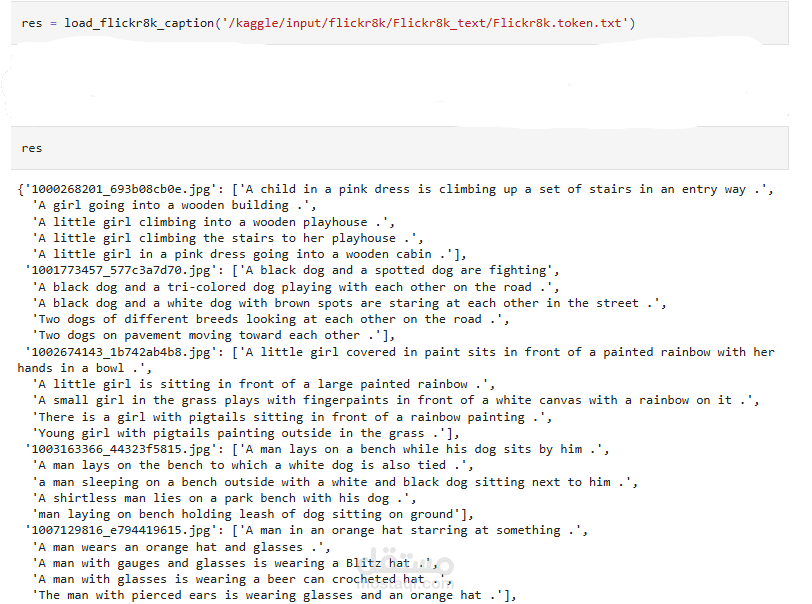

**إدارة البيانات:** العمل على مجموعة بيانات **Flickr8k** (أكثر من 8000 صورة) وتوزيعها بنسب (80% تدريب، 10% اختبار، 10% تحقق) لضمان دقة النموذج.

*

**معالجة الصور:** استخدام شبكة عصبية تلافيفية (CNN) مدربة مسبقاً لاستخراج المتجهات الميزتية (Feature Extraction).

*

**معالجة النصوص:** تنظيف النصوص، إزالة الرموز، وإضافة علامات البداية والنهاية لتهيئة البيانات للنماذج.

*

**التدريب والتحسين:** استخدام مُحسن **Adam** مع دالة الفقد (Masked Sparse Categorical Cross-entropy) لتحقيق أفضل تقارب للنتائج.

### **النتائج المحققة:**

* تفوق نموذج **LSTM** كأفضل أداء في استقرار النتائج وتقليل الفقد (Loss).

* تحقيق دقة (Validation Accuracy) تصل إلى **25.26%**، مع تفوق ملحوظ للنماذج المتقدمة (LSTM & Transformers) على النموذج التقليدي (RNN) من حيث الترابط اللغوي.

### **الأدوات والتقنيات المستخدمة:**

* **اللغات:** Python.

* **المكتبات:** TensorFlow/Keras, NumPy, Pandas.

*

**الخوارزميات:** CNN (للصور)، LSTM, RNN, Transformers (للنصوص).

---