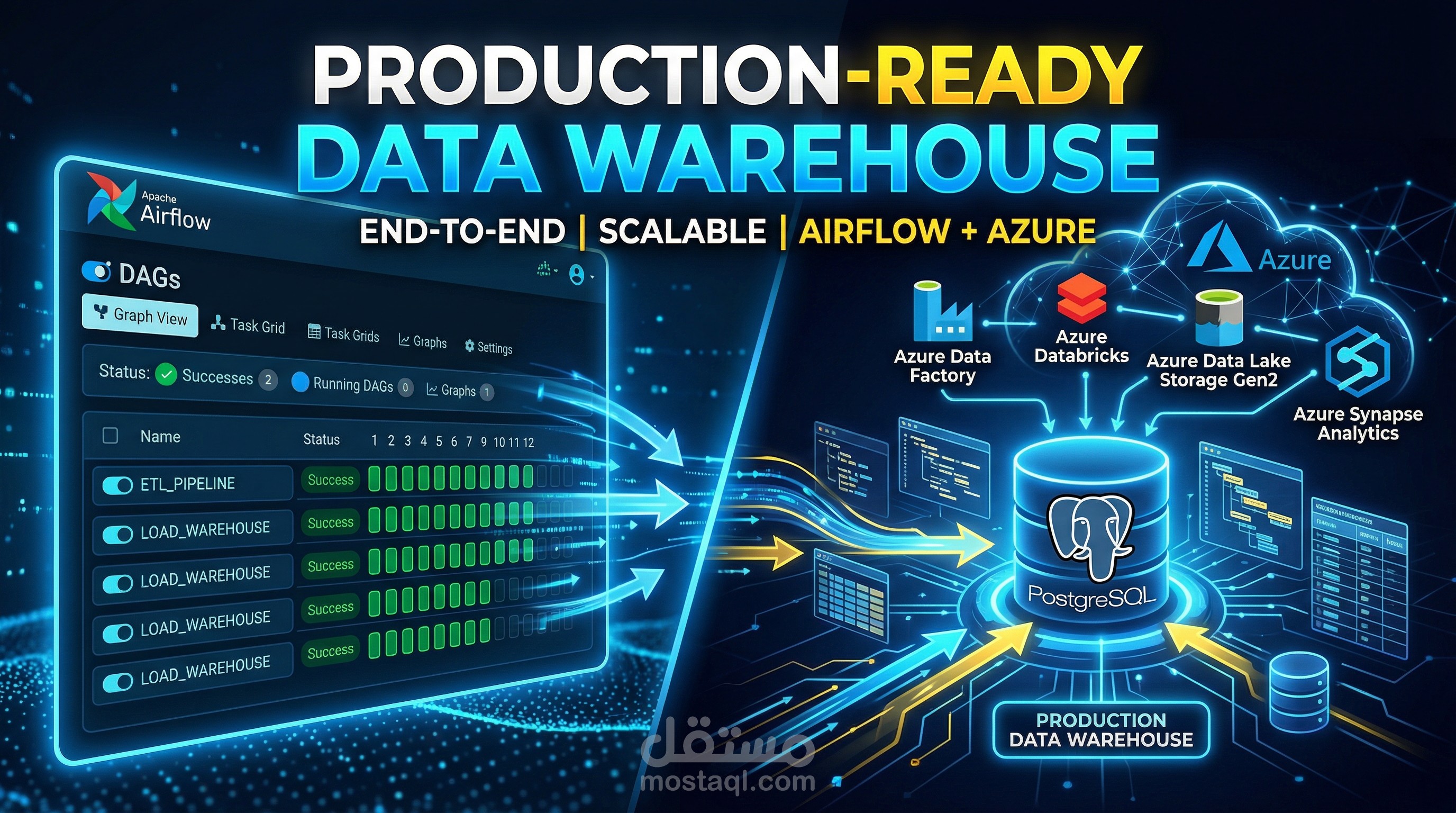

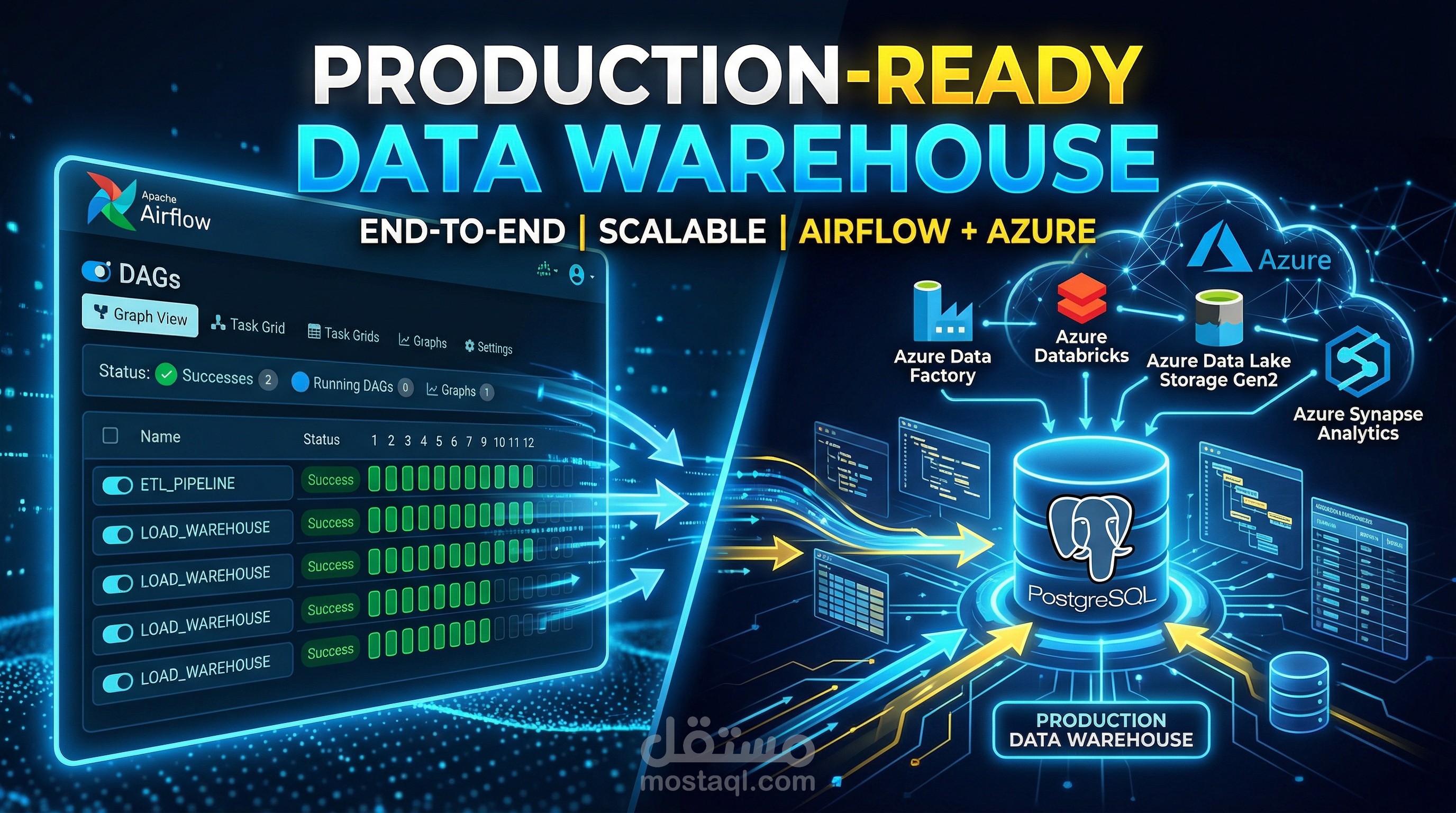

Cloud-Based Data Warehouse & ETL Pipeline باستخدام Apache Airflow و Azure

تفاصيل العمل

قمت بتصميم وتنفيذ نظام Data Pipeline احترافي يعمل بالكامل على Cloud باستخدام Azure بهدف استخراج بيانات

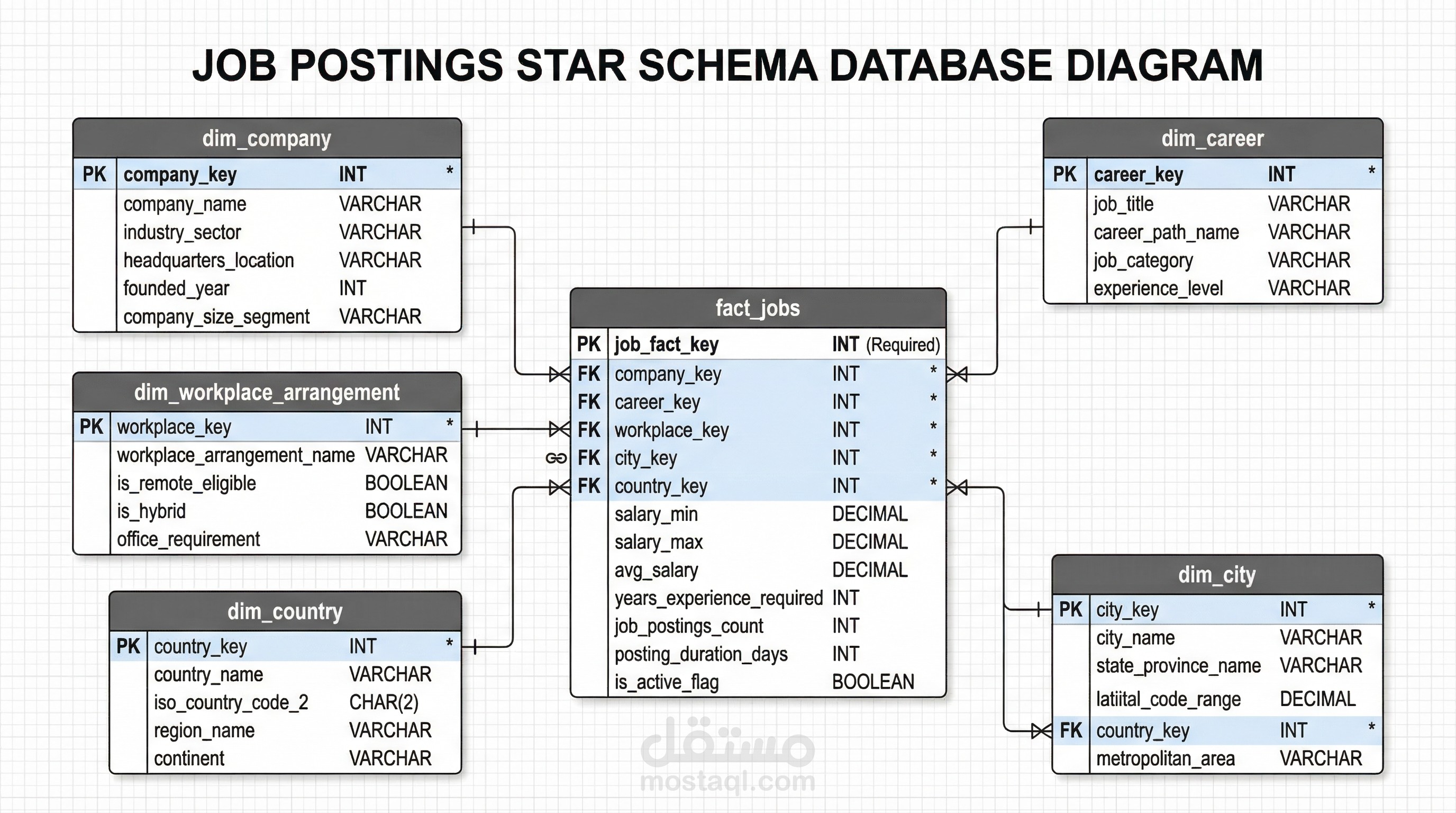

الوظائف ومعالجتها وتحميلها داخل Data Warehouse مبني وفق منهجية Star Schema

يتكون المشروع من:

- Apache Airflow باستخدام ETL Pipeline

- Data Warehouse Azure PostgreSQL Flexible Server

- Watermark Logic باستخدام Incremental Loading

- Data Quality Checks على مستوى الصفحة

- COPY + Staging Table باستخدام Bulk Upsert

- Azure Container Apps باستخدام Containerized Deployment

- Schema Migrations إدارة كاملة للـ Airflow DB

مراحل التنفيذ:

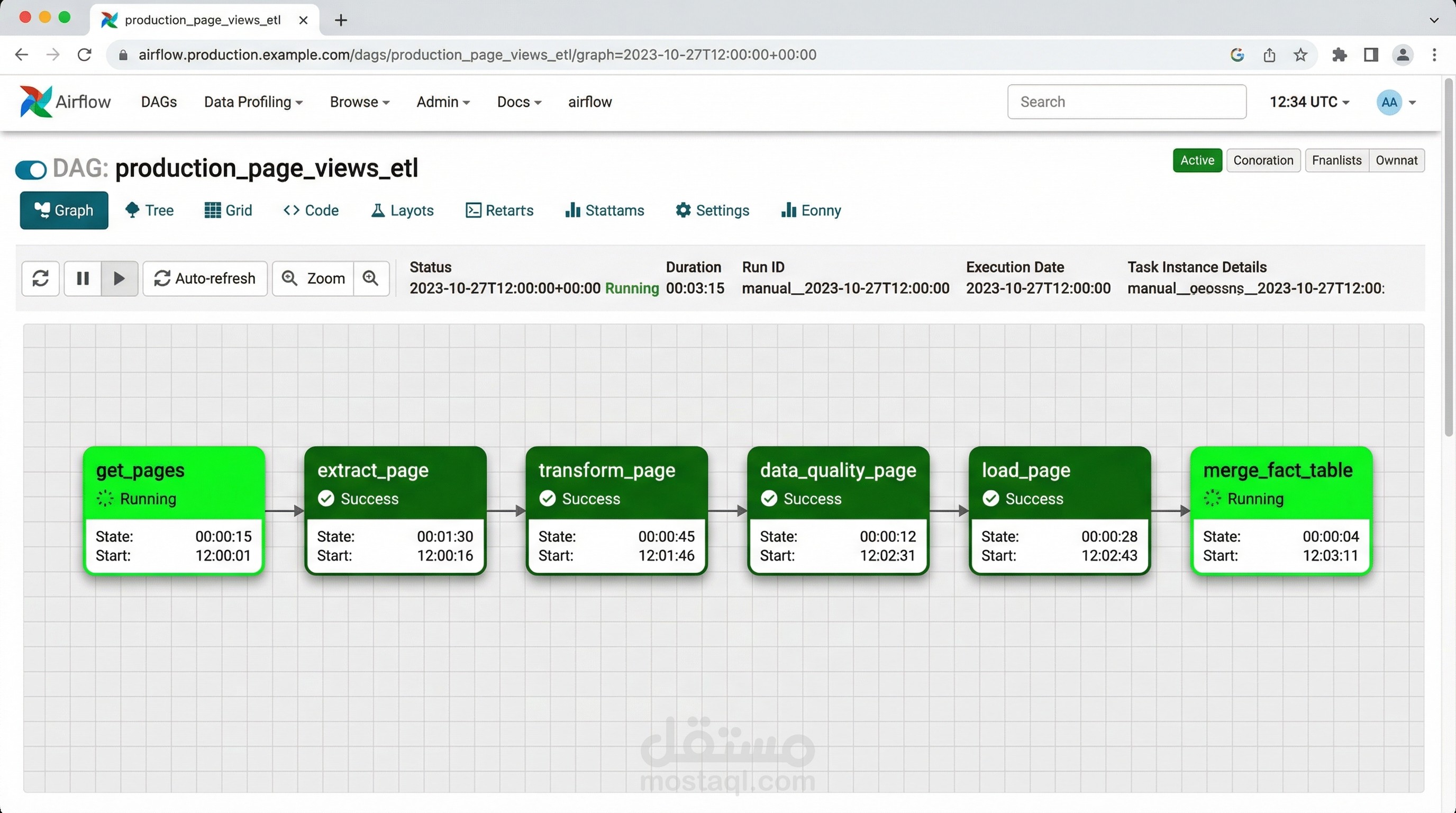

Extract .1

Incremental Extraction ودعم Pagination Handling مع API استدعاء

2. Transform

تنظيف البيانات تحويل الصيغ الزمنية، وتوحيد القيم.

Load .3

.ON CONFLICT Update مع Fact Table إلى Merge ثم Staging Table تحميل البيانات باستخدام

Data Quality Layer .4

التحقق من:

- Null timestamps

- Salary range consistency

- Duplicate job IDs

Production Deployment .5

تشغيل Airflow Webserver و Scheduler داخل Azure Container Apps مع ربط مباشر بقاعدة البيانات السحابية.

Tech stack :

- Python

- Apache Airflow 2.8

- Azure PostgreSQL Flexible Server

- Azure Container Apps

- SQLAlchemy

- Pandas

- REST API Integration

- Star Schema Data Modeling