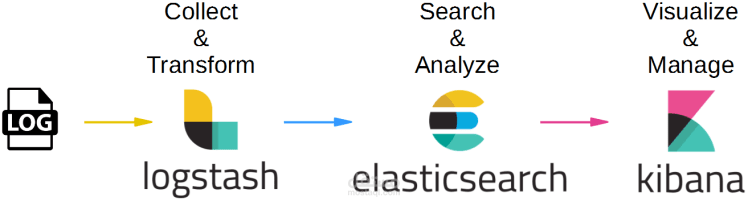

ELK Stack

تفاصيل العمل

1- في هذا المشروع قمت بتنصيب وإدارة منصة ELK Stack (Elasticsearch, Logstash, Kibana) مدمجة مع Kafka و APM-Server على عدة خوادم Bare Metal، بهدف إنشاء نظام متكامل لجمع وتحليل واستعراض السجلات (Logs) ومتابعة أداء التطبيقات.

2- إعداد Elasticsearch Cluster:

a- تنصيب Elasticsearch على 3 خوادم (خادم رئيسي Master و2 خوادم تابعة Slaves).

b- ربط الخوادم الثلاثة معًا لتشكيل Cluster متكامل، مع ضبط إعدادات Sharding وReplication لضمان التوزيع والتوافرية العالية للبيانات.

c- اختبار التزامن بين الـ Nodes والتأكد من توزيع البيانات بشكل صحيح.

3- إعداد Kafka:

a- تنصيب Apache Kafka على خادم مستقل ليكون قناة وسيطة (Message Broker) بين مصادر السجلات وLogstash.

b- إعداد Topics في Kafka لاستقبال بيانات متعددة من مصادر مختلفة.

c- التأكد من تدفق البيانات (Producers → Kafka → Consumers).

4- إعداد Logstash:

a- تنصيب Logstash على خادم مخصص.

b- ربط Logstash مع Kafka كمصدر للبيانات.

c- كتابة Pipelines لمعالجة البيانات (Parsing, Filtering, Transformation).

d- إرسال البيانات بعد المعالجة إلى Elasticsearch للتخزين والفهرسة.

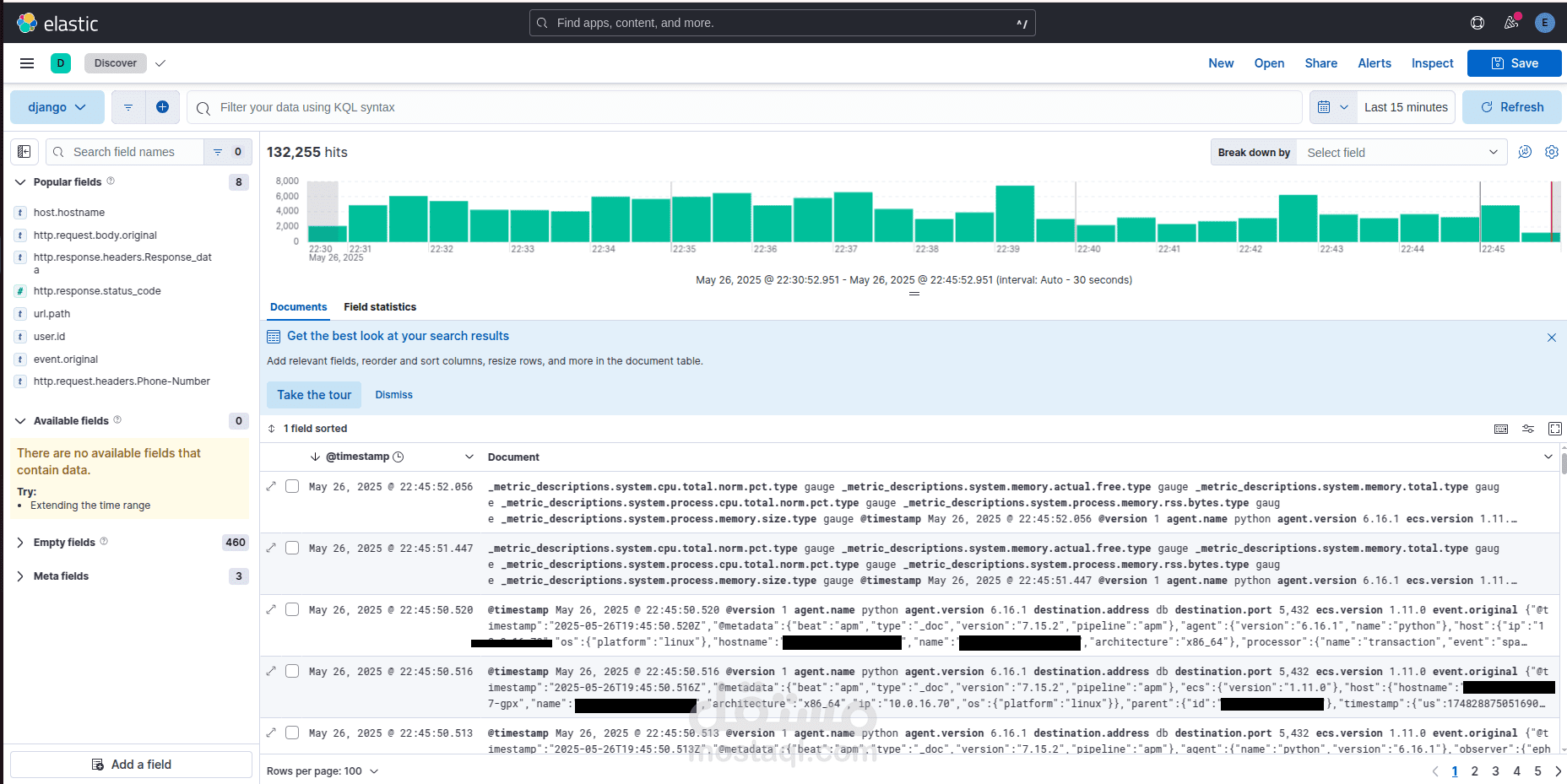

5- إعداد Kibana:

a- تنصيب Kibana على خادم مستقل وربطه مع Elasticsearch Cluster.

b- إعداد لوحات تحكم (Dashboards) تفاعلية لاستعراض السجلات وتحليلها.

c- إنشاء Visualizations لمتابعة أداء الخوادم والخدمات.

6- إعداد APM-Server:

a- تنصيب APM-Server على خادم مستقل لمراقبة أداء التطبيقات (Application Performance Monitoring).

b- ربطه مع Elasticsearch لتخزين بيانات الأداء.

c- إعداد Dashboards في Kibana لمتابعة زمن الاستجابة، الأخطاء، وحركة التطبيقات.

7- ما بعد الإعداد:

a- اختبار تدفق السجلات من مصادر متعددة (مثل تطبيقات وخوادم).

b- التحقق من قدرة النظام على التعامل مع حجم كبير من البيانات بشكل لحظي (Real-Time).

c- ضمان التوافرية والاعتمادية عبر توزيع الخدمات على عدة خوادم.

8- القيمة المضافة من المشروع:

a- خبرة عملية في بناء Cluster موزع باستخدام Elasticsearch.

b- فهم معمق لتدفق البيانات عبر Kafka → Logstash → Elasticsearch → Kibana.

c- تطوير مهارات في مراقبة الأداء (APM) وتحليل السجلات لحل المشكلات.

d- إنشاء نظام قابل للتوسع للتعامل مع Big Data Logging & Monitoring.