ASL recognizer

تفاصيل العمل

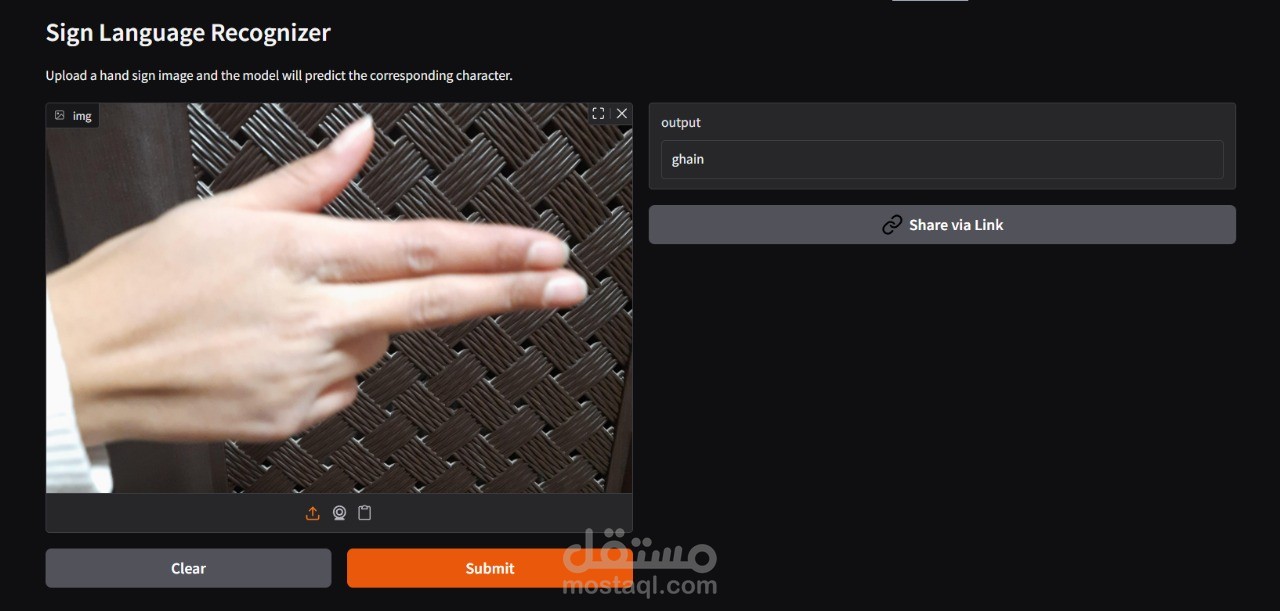

ASL Model Recognizer

قمتُ بتطوير نموذج للتعرّف على لغة الإشارة الأمريكية (ASL) باستخدام تقنيات الذكاء الاصطناعي ومعالجة الصور.

تفاصيل المشروع:

? بناء نموذج ذكاء اصطناعي يعتمد على الشبكات العصبية العميقة (Deep Learning) للتعرف على إشارات اليد الخاصة بـ ASL.

معالجة الصور والفيديو عبر مكتبات مثل OpenCV و TensorFlow/Keras لتحويل إشارات اليد إلى بيانات رقمية قابلة للتصنيف.

️ تدريب النموذج على مجموعة بيانات تحتوي على صور/إشارات متعددة لضمان دقة عالية في التعرّف.

️ تطوير واجهة تجريبية تسمح للمستخدم بإدخال صورة أو استخدام الكاميرا، ثم يحصل على الترجمة الفورية للإشارة.

اختبارات وتقييم الأداء باستخدام مقاييس مثل Accuracy و Confusion Matrix لضمان فعالية النموذج.

النتيجة:

المشروع يُظهر قدرة الذكاء الاصطناعي على جعل التواصل أكثر سهولة مع مجتمع الصم وضعاف السمع، ويعكس خبرتي في الرؤية الحاسوبية (Computer Vision) وتطبيقات الـ Machine Learning.