تصنيف مشاعر القطط باستخدام الرؤية الحاسوبية

تفاصيل العمل

هذا المشروع عبارة عن تطبيق ويب تفاعلي يُحلل تدفقات الفيديو في الوقت الفعلي لاكتشاف القطط وتصنيف مشاعرها. باستخدام نموذج ذكاء اصطناعي مُدرّب خصيصًا، يُمكنه تحديد مشاعر مثل "الاسترخاء"، "الانتباه"، "السعادة"، أو "عدم الارتياح" من مظهر القطة، وعرض النتائج مباشرةً على صفحة الفيديو.

الميزات الرئيسية

التحليل الفوري: يُعالج الفيديو من كاميرا ويب مباشرة أو ملف مُحمّل لتوفير تنبؤات فورية بالمشاعر.

١١ فئة مميزة من المشاعر: تم تدريب النموذج على التعرف على نطاق دقيق من ١١ مشاعر مختلفة للقطط.

واجهة ويب تفاعلية: واجهة مستخدم رسومية سهلة الاستخدام مُصممة باستخدام Streamlit تُتيح لأي شخص استخدام الأداة بسهولة دون أي معرفة تقنية.

خط أنابيب الذكاء الاصطناعي المتقدم: يجمع التطبيق بذكاء بين كاشف عام للأشياء ومصنف متخصص للعواطف للحصول على نتائج دقيقة.

كيف يعمل

يستخدم التطبيق خط أنابيب ذكاء اصطناعي متطورًا من خطوتين لكل إطار من الفيديو:

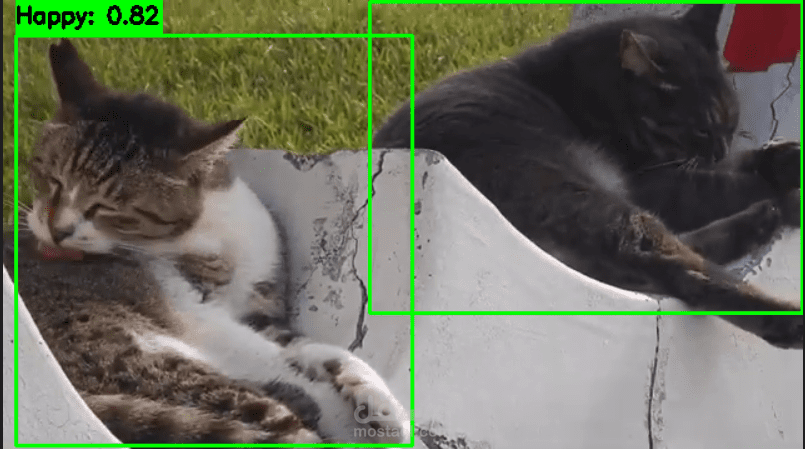

الخطوة 1: اكتشاف القطط: يقوم نموذج YOLOv8 المُدرَّب مسبقًا لكشف الأشياء بمسح الإطار لتحديد أي قطط وتحديد موقعها، مع رسم إطار محيط حول كل منها.

الخطوة 2: تصنيف المشاعر: يتم اقتصاص الصورة داخل الإطار المحيط وإدخالها في نموذج تصنيف YOLOv8 المُدرَّب خصيصًا. يُحلِّل هذا النموذج المُتخصص، وهو جوهر المشروع، سمات القطة للتنبؤ بمشاعرها.

النتيجة النهائية هي بث فيديو، حيث يتم تمييز كل قطة مُكتشفة بعلامة تُظهر مشاعرها المتوقعة ومستوى ثقة النموذج.

مجموعة التقنيات

إطار عمل الذكاء الاصطناعي: YOLOv8 (Ultralytics) على PyTorch

رؤية الكمبيوتر: OpenCV

واجهة المستخدم الرسومية للويب: Streamlit

اللغة الأساسية: Python