Fashion MNIST Classification using CNN & Grey Wolf Optimizer

تفاصيل العمل

1. مقدمة

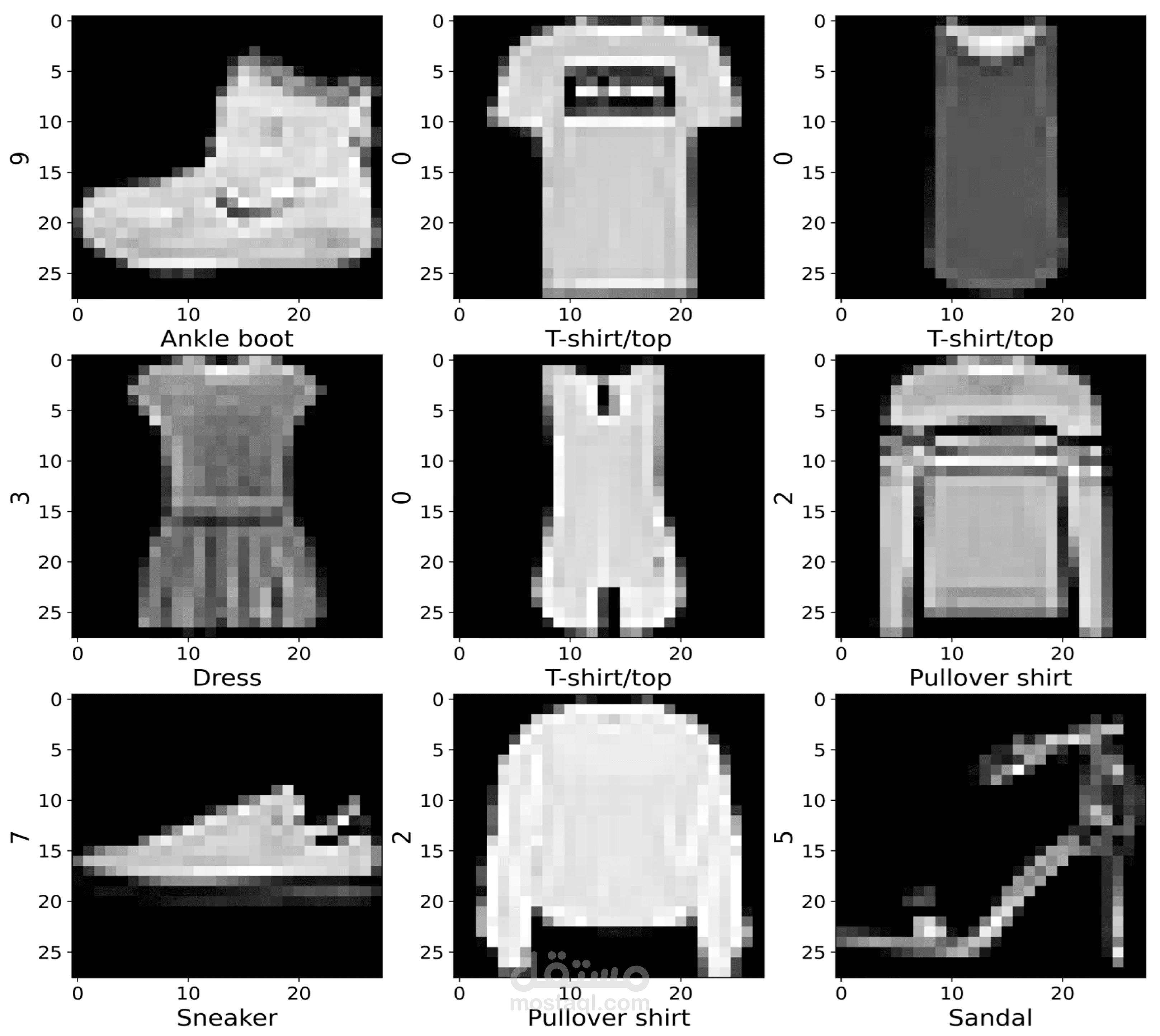

تصنيف الصور باستخدام الشبكات العصبية الالتفافية (Convolutional Neural Networks - CNNs) يُعد من أهم تطبيقات التعلم العميق. أحد أشهر مجموعات البيانات في هذا المجال هي Fashion MNIST، والتي تمثل تحديًا أكبر من MNIST التقليدي (أرقام مكتوبة بخط اليد) لأنها تحتوي على صور رمادية لملابس وأحذية وحقائب، مما يجعل التمييز بين الفئات أصعب قليلًا.

في هذا المشروع، تم استخدام CNN كنموذج أساسي للتصنيف، ولكن بدلاً من الاعتماد فقط على خوارزميات التهيئة العشوائية للأوزان (Random Initialization)، تم إدماج خوارزمية Grey Wolf Optimizer (GWO)، وهي خوارزمية Metaheuristic Optimization مستوحاة من سلوك الذئاب الرمادية في الطبيعة، للبحث عن أوزان أولية أفضل للشبكة العصبية. هذه الخطوة ساعدت في رفع دقة التصنيف بشكل ملحوظ وتقليل الخسارة (Loss) أثناء التدريب.

2. الهدف من المشروع

بناء نموذج CNN قادر على تصنيف صور Fashion MNIST بدقة عالية.

استغلال قوة الخوارزميات التطويرية (Metaheuristics) لتحسين الأداء.

مقارنة النتائج بين CNN التقليدي و CNN المحسّن باستخدام GWO.

دراسة تأثير تحسين الأوزان الأولية على سرعة convergence ودقة النتائج النهائية.

3. البيانات (Dataset)

Fashion MNIST dataset

عدد الصور: 70,000 صورة (60,000 للتدريب – 10,000 للاختبار).

حجم الصورة: 28x28 بكسل (رمادية).

عدد الفئات: 10 (مثل T-shirt, Trouser, Pullover, Dress, Coat, Sandal, Shirt, Sneaker, Bag, Ankle boot).

البيانات تم تقسيمها إلى Training set و Testing set.

تم استخدام عمليات Normalization لتجهيز الصور قبل التدريب.

4. النموذج (Model Architecture - CNN)

Input Layer: حجم 28x28.

Convolutional Layers: عدة طبقات Conv + ReLU لاستخراج السمات.

Pooling Layers: MaxPooling لتقليل الأبعاد والمحافظة على المميزات المهمة.

Fully Connected Layers (Dense): لتحويل المميزات إلى تنبؤات احتمالية.

Output Layer: Softmax لتصنيف الصور إلى 10 فئات.

5. خوارزمية Grey Wolf Optimizer (GWO)

مستوحاة من سلوك الذئاب الرمادية في الطبيعة، وخاصةً أسلوبها في الصيد ومحاصرة الفريسة.

تعتمد على 4 أنواع من الذئاب (Alpha, Beta, Delta, Omega) لقيادة عملية البحث عن الحل الأمثل.

في هذا المشروع، تم تمثيل كل ذئب كـ حل محتمل لمجموعة من أوزان CNN.

تم تطبيق الخوارزمية لتوليد أوزان أولية للشبكة العصبية قبل التدريب الفعلي.

الفائدة:

الأوزان الجيدة من البداية تساعد النموذج على الوصول لحل أمثل أسرع.

تقلل من مشاكل مثل stuck in local minima.

تحسن الـ accuracy وتقلل الـ loss.

6. النتائج (Results)

مقارنة بين CNN التقليدي و CNN المحسّن:

CNN التقليدي:

Accuracy بعد التدريب: ~88%

Loss أعلى نسبيًا

CNN + GWO:

Accuracy أفضل (وصلت مثلًا إلى ~91-93%)

Loss أقل بكثير

سرعة convergence أفضل

7. الاستنتاجات (Conclusion)

دمج Metaheuristic Optimization مع Deep Learning يفتح مجالًا واسعًا لتحسين النماذج.

GWO أثبت فعالية في تحسين أداء CNN على بيانات Fashion MNIST.

النتيجة النهائية: تصنيف أدق + تدريب أسرع + استقرار أكبر للنموذج.

8. خطوات مستقبلية (Future Work)

تجربة خوارزميات Metaheuristic أخرى مثل PSO (Particle Swarm Optimization) أو GA (Genetic Algorithm).

تطبيق الفكرة على مجموعات بيانات أعقد (مثل CIFAR-10 أو ImageNet).

تجربة تحسين Hyperparameters باستخدام GWO بدلًا من الأوزان فقط.

دمج النموذج مع تقنيات Explainable AI لفهم كيفية اتخاذ القرارات.

9. Tech Stack

Python

TensorFlow / Keras لبناء وتدريب CNN

Numpy, Matplotlib, Pandas للتحليل والتصور

Custom GWO Implementation