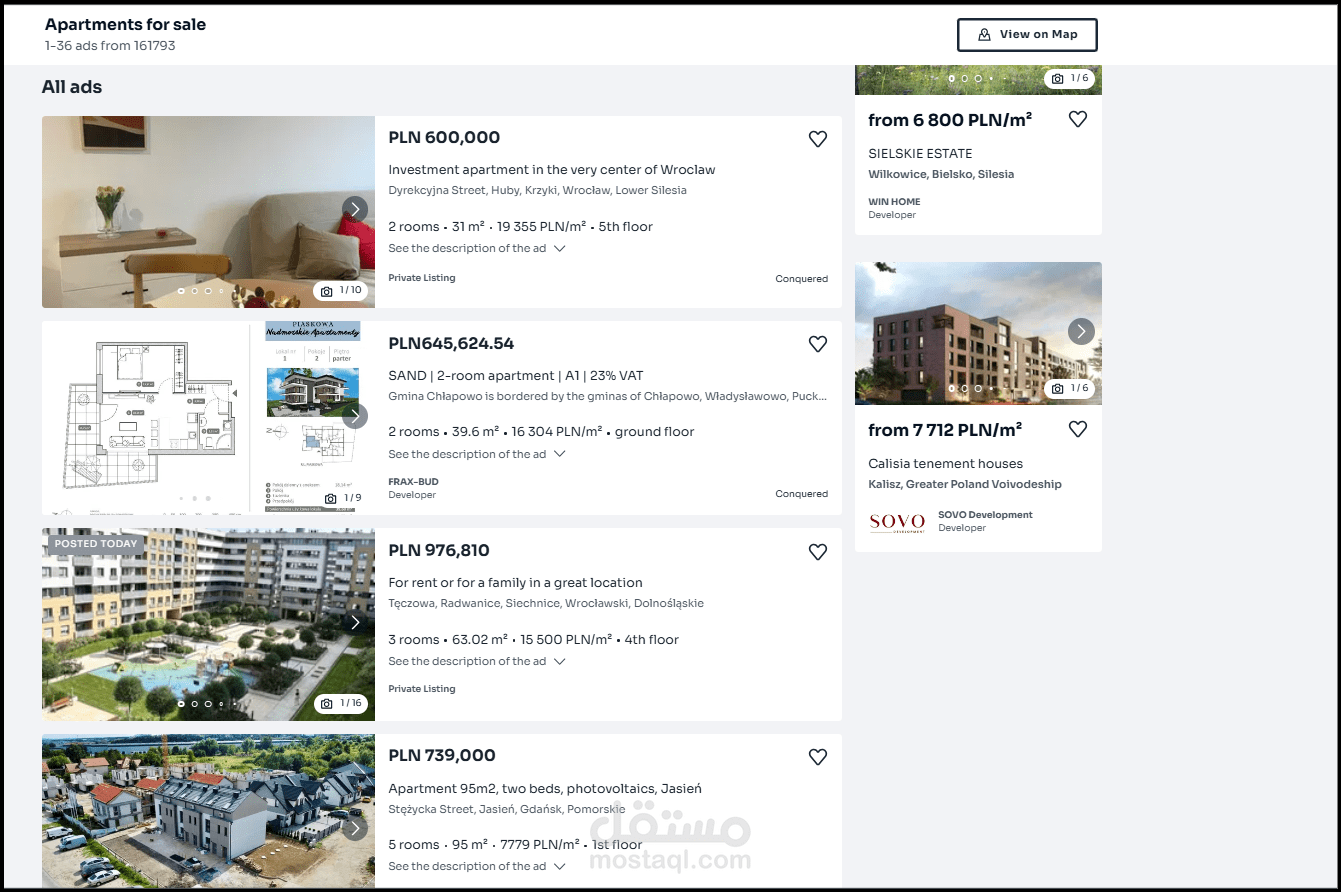

استخراج المعلومات من موقع عقارات

تفاصيل العمل

استخراج عشره الاف اعلان من موضع عقارات بولندي معروف. ثم قمت بتنظيف البيانات باستخدام بايثون لتكون جاهزة للتحليل. ثم قمت برفع البيانات ل snowflake لمزيد من الاستكشاف.

خطوات العمل:

- فحص الموقع و كيفيه طلب المعلومات و تنظيمها في ال html script

- اختبار امكانيه الحصول عالمعلومات المطلوبه باستخدام المكتبات scrapy shell or beautiful soup or selenium

- كتابه python spider لاستخراج المعلومات باستخدام scrapy framework

- كتابه python pipelines script لتنظيف البيانات قبل تخزينها

- تعديل اعدادات scrapy لاستخدام fake headers و تخزين البيانات في ملف بالصيغه المطلوبه او بقاعدة بيانات حسب المطلوب

ملفات مرفقة

بطاقة العمل

| اسم المستقل | Karim A. |

| عدد الإعجابات | 0 |

| عدد المشاهدات | 4 |

| تاريخ الإضافة | |

| تاريخ الإنجاز |